Gigabyte уже довольно давно представила семейство видеокарт GeForce GTX 680 OC, которое включает модели Super Overclock (тест и обзор Hardwareluxx), и мы уже опубликовали результаты тестирования видеокарты. Её можно смело назвать одной из самых экстремальных моделей этого года. На днях в нашу тестовую лабораторию поступила новая модель из семейства Gigabyte GeForce GTX 680 OC, которая тоже опирается на заводской разгон, хотя и не достигает уровня топовой видеокарты Super Overclock. Зато объём видеопамяти был удвоен до 4 Гбайт. Мы решили проверить производительность новинки на практике, и Gigabyte GeForce GTX 680 OC хорошо дополняет ассортимент 4-Гбайт видеокарт, побывавших в нашей тестовой лаборатории.

Gigabyte уже довольно давно представила семейство видеокарт GeForce GTX 680 OC, которое включает модели Super Overclock (тест и обзор Hardwareluxx), и мы уже опубликовали результаты тестирования видеокарты. Её можно смело назвать одной из самых экстремальных моделей этого года. На днях в нашу тестовую лабораторию поступила новая модель из семейства Gigabyte GeForce GTX 680 OC, которая тоже опирается на заводской разгон, хотя и не достигает уровня топовой видеокарты Super Overclock. Зато объём видеопамяти был удвоен до 4 Гбайт. Мы решили проверить производительность новинки на практике, и Gigabyte GeForce GTX 680 OC хорошо дополняет ассортимент 4-Гбайт видеокарт, побывавших в нашей тестовой лаборатории.

Gigabyte - один из немногих производителей, кто вообще не предложил GeForce GTX 680 в эталонном дизайне. Как правило, продукты этого производителя фокусируются на альтернативной системе охлаждения и заводском разгоне, всё это привело к отличным позициям в наших тестах. Что касается цены, то видеокарта Gigabyte GeForce GTX 680 OC с 4 Гбайт видеопамяти обойдётся в Европе от 489 евро, а в России - от 18,3 тыс. рублей. Если вы можете обойтись без 2 Гбайт дополнительной видеопамяти, то видеокарту можно приобрести чуть дешевле - от 422 евро в Европе или от 16,7 тыс. рублей в России.

Спецификации видеокарты приведены в следующей таблице:

| Обзор видеокарт GeForce GTX 680 | ||

|---|---|---|

| Модель | NVIDIA GeForce GTX 680 | Gigabyte GeForce GTX 680 OC 4 GB |

| Розничная цена | от 417 евро в Европе от 14,4 тыс. рублей в России |

от 489 евро в Европе от 18,3 тыс. рублей в России |

| Сайт производителя | NVIDIA | Gigabyte |

| Технические характеристики | ||

| GPU | GK104 (GK104-400-A2) | GK104 (GK104-400-A2) |

| Техпроцесс | 28 нм | 28 нм |

| Число транзисторов | 3,54 млрд. | 3,54 млрд. |

| Тактовая частота GPU | 1006 МГц (Boost: 1058 МГц) | 1072 МГц (Boost: 1137 МГц) |

| Частота памяти | 1502 МГц | 1502 МГц |

| Тип памяти | GDDR5 | GDDR5 |

| Объём памяти | 2048 Мбайт | 4096 Мбайт |

| Ширина шины памяти | 256 бит | 256 бит |

| Пропускная способность | 192,3 Гбайт/с | 192,3 Гбайт/с |

| Версия DirectX | 11.1 | 11.1 |

| Потоковые процессоры | 1536 (1D) | 1536 (1D) |

| Текстурные блоки | 128 | 128 |

| Конвейеры растровых операций | 32 | 32 |

| Пиксельная скорость заполнения | 32,2 Гпиксель/с | 34,3 Гпиксель/с |

| TDP | 195 Вт | 195 Вт |

| SLI/CrossFire | SLI | SLI |

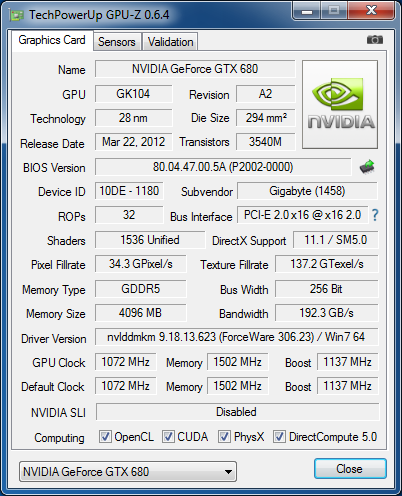

В отличие от версии Super Overclock, у видеокарты Gigabyte GV-N680OC-4GD не используется экстремального разгона, частоты нельзя назвать существенно увеличенными: штатная частота GPU 1006 МГц была увеличена до 1072 МГц. В режиме Boost частота увеличивается, как минимум, до уровня 1137 МГц. Память работает на 1502 МГц. Все другие спецификации соответствуют GeForce GTX 680.

Влияние 4 Гбайт видеопамяти на производительность мы оценивали уже несколько раз, мы не получаем увеличения производительности в большинстве приложений и настроек. Выигрыш от удвоения видеопамяти заметен только в ограниченных сценариях.

GPU-Z корректно распознаёт технические спецификации видеокарты.

С первого взгляда видно, что видеокарта скрыта за хорошо известным кулером WindForce 3X, знакомым нам по другим продуктам Gigabyte. Он может рассеивать до 450 Вт энергии. Gigabyte указывает, что под нагрузкой Furmark уровень фонового шума составляет 28 дБ. Впрочем, значение указано без эталонной точки отсчета, да и тестовое окружение не описывается. Мы проводим самостоятельные тесты уровня шума, которые позволят лучше оценить новинку.

Сзади печатной платы видно, что Gigabyte использовала не эталонный дизайн, а собственную разработку. Можно заметить восемь чипов памяти из 16.

Благодаря двум разъёмам SLI в конфигурацию 3-Way SLI можно объединять до трёх видеокарт. Впрочем, из-за 3-слотового дизайна системы охлаждения подобная конфигурация получится далеко не на все материнских платах.

Для подачи питания на видеокарту в дополнение к слоту PCI-Express предусмотрены по одному 6- и 8-контактному разъёму. Так что теоретически поддерживается питание до 300 Вт.

Мы уже упомянули, что на карту установлено 16 чипов памяти от Samsung ёмкостью 256 Мбайт. Они работают по спецификациям на частоте 1500 МГц, но и 1502 МГц для них никакой проблемы не составляют. Восемь чипов спереди закрыты большим радиатором, на задней стороне платы они обходятся без активного охлаждения.

Слотовая заглушка занимает три слота, поэтому на ней производитель нанёс большое количество отверстий, через которые выбрасывается наружу горячий воздух. Но Gigabyte не использовала кожух для направления воздушного потока, поэтому через отверстия выбрасывается лишь небольшая часть потока. Кроме вентиляционных отверстий на слотовых заглушках присутствуют многочисленные порты. Gigabyte установила по одному видеовыходу HDMI и DisplayPort, а также 2x двухканальных DVI (DVI-I и DVI-A).

Три толстые тепловые трубки гарантируют, что тепло будет быстро отводиться от GPU на два радиатора. Два 70-мм вентилятора сверху обеспечивают достаточное количество прохладного воздуха. Чипы памяти спереди накрыты радиатором, но чипы памяти сзади никак не охлаждаются.

Для проведения тестирования мы обновили нашу тестовую систему, а также и поколение драйверов. Процессор Intel Core i7-3960X был разогнан со штатной частоты 3,2 ГГц до 4,2 ГГц, чтобы максимально устранить "узкое место" по производительности CPU. Мы использовали следующие компоненты:

| Тестовая конфигурация | |

|---|---|

| Процессор | Intel Core i7-3960X 3,3 ГГц, разгон до 4,2 ГГц |

| Материнская плата | ASUS P9X79 |

| Оперативная память | ADATA XPG Gaming Series Low Voltage 4x 2 Гбайт PC3-12800U CL 9-9-9-24 |

| Накопитель | ADATA S510 SSD 60 Гбайт |

| Блок питания | Seasonic Platinum Series 1000 Вт |

| Операционная система | Windows 7 64 Bit с SP1 |

| Видеокарты | |

| NVIDIA | NVIDIA GeForce GTX 690 (915/1502 МГц, 4096 Мбайт) |

| NVIDIA GeForce GTX 680 (1006/1502 МГц, 2048 Мбайт) | |

| NVIDIA GeForce GTX 670 (915/1502 МГц, 2048 Мбайт) | |

| NVIDIA GeForce GTX 660 Ti (915/1502 МГц, 2048 Мбайт) | |

| NVIDIA GeForce GTX 660 (1058/1250 МГц, 2048 Мбайт) | |

| NVIDIA GeForce GTX 650 Ti (925/1350 МГц, 2048 Мбайт) | |

| NVIDIA GeForce GTX 650 (1058/1250 МГц, 1024/2048 Мбайт) | |

| NVIDIA GeForce GTX 590 (608/1215/854 МГц, 3072 MB - 1536 Мбайт эффективное значение) | |

| NVIDIA GeForce GTX 580 (772/1544/1000 МГц, 1536 Мбайт) | |

| NVIDIA GeForce GTX 570 (732/1464/950 МГц, 1280 Мбайт) | |

| NVIDIA GeForce GTX 560 Ti 448 Cores (732/1464/950 МГц, 1280 Мбайт) | |

| NVIDIA GeForce GTX 560 Ti (820/1640/1000 МГц, 1024 Мбайт) | |

| NVIDIA GeForce GTX 560 (810/1620/1002 МГц, 1024 Мбайт) | |

| NVIDIA GeForce GTX 550 Ti (900/1800/1026 МГц, 1024 Мбайт) | |

| AMD | AMD Radeon HD 7970 GHz Edition (1050/1050/1500 МГц, 3072 Мбайт) |

| AMD Radeon HD 7970 (925/925/1375 МГц, 3072 Мбайт) | |

| AMD Radeon HD 7950 (800/800/1250 МГц, 3072 Мбайт) | |

| AMD Radeon HD 7870 (1000/1000/1200 МГц, 2048 Мбайт) | |

| AMD Radeon HD 7850 (860/860/1200 МГц, 2048 Мбайт) | |

| AMD Radeon HD 7770 (1000/1000/1125 МГц, 1024 Мбайт) | |

| AMD Radeon HD 7750 (800/800/1125 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6990 (830/830/1250 МГц, 4096 Мбайт - 2048 Мбайт эффективная) | |

| AMD Radeon HD 6970 (880/880/1375 МГц, 2048 Мбайт) | |

| AMD Radeon HD 6950 (800/800/1200 МГц, 2048 Мбайт) | |

| AMD Radeon HD 6870 (900/900/1050 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6850 (775/775/1000 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6790 (840/840/1050 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6770 (850/850/1200 МГц, 1024 Мбайт) | |

| Драйверы | |

| NVIDIA | GeForce 306.38 |

| AMD | Catalyst 12.7 |

Мы выражаем благодарность ASUS, Intel, ADATA, Thermaltake и Seasonic за предоставленные компоненты.

Настройки драйверов NVIDIA:

- Текстурная фильтрация: Качество

- Сглаживание- гамма-коррекция: Да

- Текстурная фильтрация - оптимизация анизотропии: Нет

- Текстурная фильтрация - отрицательный LOD Bias: Заблокировано

Текстурные настройки AMD:

- Текстурная фильтрация: Качество

- Catalyst AI: Выключен/ Качество

Ниже приведены настройки тестов, использованных нами:

Futuremark 3DMark 11 (DX11):

- Entry

- Performance

- Extreme

LuxMark 2.0 (OpenCL):

- Sala

Anno 2070 (DX11):

- 1680x1050 AA без 16xAF

- 1680x1050 MLAA 16xAF

- 1920x1080 AA без 16xAF

- 1920x1080 MLAA 16xAF

- 2560x1600 AA без 16xAF

- 2560x1600 MLAA 16xAF

Battlefield 3 (DX11):

- 1680x1050 1xAA 16xAF

- 1680x1050 4xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 4xAA 16XAF

- 2560x1600 1xAA 16xAF

- 2560x1600 4xAA 16xAF

Call of Duty: Modern Warfare 3 (DX9):

- 1680x1050 4xAA 16xAF

- 1920x1080 4xAA 16xAF

- 2560x1600 4xAA 16xAF

Crysis Warhead (DX10):

- 1680x1050 1xAA 16xAF

- 1680x1050 8xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 8xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 8xAA 16xAF

Crysis 2 (DX11):

- 1680x1050 1xAA 16xAF

- 1680x1050 16xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 16xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 16xAA 16xAF

Rage (OpenGL):

- 2560x1600 8xAA 16xAF

The Elder Scrolls V: Skyrim (DX9):

- 1680x1050 1xAA 16xAF

- 1680x1050 8xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 8xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 8xAA 16xAF

The Witcher 2 (DX9):

- 1680x1050 AA aus 16xAF

- 1680x1050 MLAA 16xAF

- 1920x1080 AA aus 16xAF

- 1920x1080 MLAA 16xAF

- 2560x1600 AA aus 16xAF

- 2560x1600 MLAA 16xAF

Metro 2033 (DX11):

- 1680x1050 1xAA 16xAF

- 1680x1050 4xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 4xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 4xAA 16xAF

После обновления нашей тестовой системы мы выполняем измерения энергопотребления, температуры и уровня шума. Максимальное энергопотребление, температура и уровень шума измеряются под нагрузкой игрой Crysis 2 в разрешении 1920 x 1080 пикселей с активными режимами повышения качества AF / AA. Оставшиеся три измерения в режиме бездействия мы проводили через десять минут после старта системы. Уровень шума мы измеряли с расстояния 30 см.

Энергопотребление всей системы в режиме бездействия, Вт.

В режиме бездействия все видеокарты категории GeForce GTX 680 показывают довольно близкий уровень энергопотребления. Разница не превышает считаных ватт, вряд ли она будет заметна на счёте за электроэнергию. Так что по энергопотреблению в режиме бездействия не имеет смысла рекомендовать ту или иную модель. Gigabyte GeForce GTX 680 Overclock показала вполне хорошие результаты.

Энергопотребление всей системы под нагрузкой, Вт.

По энергопотреблению под нагрузкой уже можно сравнивать эффективность протестированных видеокарт. Как правило, видеокарты с более высокими частотами заводского разгона выходят вперёд по энергопотреблению, особенно если разгон сопровождается повышением напряжения. Поскольку Gigabyte GeForce GTX 680 Overclock обеспечивает довольно скромный заводской разгон, то и энергопотребление оказывается довольно ограниченным.

Температура в режиме бездействия, градусы Цельсия.

Нам понравился кулер WindForce 3X видеокарты Gigabyte GeForce GTX 680 Overclock. В режиме бездействия температура GPU не поднималась выше 32 °C. Посмотрим, будет ли сочетаться низкая температура с низким уровнем шума.

Температура под нагрузкой, градусы Цельсия.

Под нагрузкой видеокарта Gigabyte GeForce GTX 680 Overclock тоже нагревается не так сильно - максимальная температура составила 70 °C.

Уровень шума в режиме бездействия, дБ(А).

Конечно, при оценке температуры на диаграммах выше необходимо учитывать и уровень шума. Мы получили уровень 34,5 дБ(A) в режиме бездействия, который можно назвать очень хорошим - тише работала только одна видеокарта GTX 680 в наших тестах. Gigabyte реализовала продуманный профиль работы вентиляторов, благодаря которому мы получаем очень тихую работу.

Уровень шума под нагрузкой, дБ(А).

Схожую картину мы получаем и под нагрузкой. Опять же, эффективность охлаждения Gigabyte GeForce GTX 680 Overclock приятно радует. Некоторые другие видеокарты сравнимы по температуре, но шумят громче модели Gigabyte. Под нагрузкой мы получаем одну из самых тихих видеокарт GeForce GTX 680 в наших тестах.

Мы добавили в наши тесты последнее поколение 3DMark. 3DMark 11 является первым тестом, полностью ориентированным на DirectX 11, от разработчика Futuremark. Именно по этой причине тест интенсивно использует тесселяцию, глубину поля резкости, объёмное освещение и DirectCompute. Вполне логичным кажется требование по наличию многоядерного процессора с количеством ядер не меньше четырёх. Скачать тест можно в соответствующем разделе нашего сайта.

AMD и NVIDIA всегда подчёркивают вычислительную производительность своих GPU. И в дополнение к многочисленным движкам с поддержкой OpenCL, мы также решили оценить вычислительную производительность отдельно. Мы взяли тест LuxMark 2.0, тестовую сцену "Sala" с использованием RayTracing, результат теста выводится в сэмплах в секунду. Скачать LuxMark 2.0 можно по следующей ссылке.

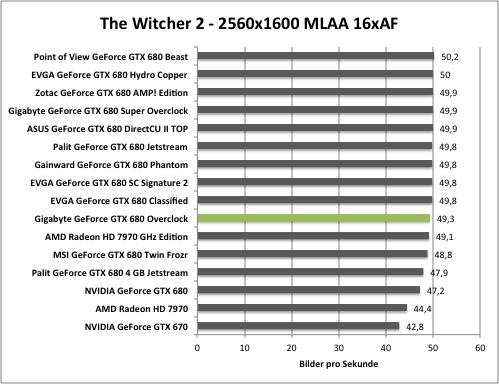

Во второй части знаменитой ролевой саги "Ведьмак/The Witcher" Геральту из Ривии снова противостоят полчища тварей. С помощью меча и магии игроку предстоит пройти многочисленные локации фантастического игрового мира, радующего вниманием к деталям. Вторая часть игры под названием "Убийца королей/Assassins of Kings" стала успешным продолжением первой игры в развитии нелинейного сюжета, когда действия игрока влияют на ход игры. Игра вышла в 2010 году, и специально разработанный для неё Red Engine (DX9) смог поднять стандарты качества графики ролевых игр на новую планку. Геймеры и журналисты с одобрением встретили новую игру. И разработчики движка RED, компания CD Projekt, не зря назвали свой движок "лучшим в мире для ролевых игр".

Игра Call of Duty - Modern Warfare 3, вышедшая в конце 2011 года, стала восьмой в весьма успешном семействе. Шутер от первого лица позволяет насладиться активным геймплеем в реальном режиме времени, который перемежается с сюжетными вставками кинематографического качества. Геймер погружается в брутальную атмосферу игры благодаря богатым возможностям движка IW Engine 4.0 (DX9), оказываясь в гуще боевых событий. Если верить разработчикам, движок отличается от конкурирующих решений возможностью вертикального геймплея и проработанными детализованными текстурами.

Игра Anno 2070 отличается от предшествующих игр серии тем, что действие происходит не в прошлом, а через 60 лет в будущем. Геймплей во многом похож, то есть вам нужно исследовать и открывать острова, колонизировать их, создавать циклы производства продукции и развития поселений, чтобы удовлетворять потребности общества, а также выстраивать дипломатические отношения с соседями. В игру были введены три фракции: Эко/Eco нацеливаются на развитие возобновляемых источников энергии и сохранение природы, Магнаты/Tycoons не стесняются загрязнять окружающую среду ради прибыльной работы тяжелой промышленности. Третья фракция Техи/Techs развивают новые технологии и осваивают морские глубины. Большие острова, живая флора и фауна, впечатляющие эффекты воды и растительности - всё это в изобилии имеется в игре благодаря движку Related Designs (DX11), и высокие настройки детализации накладывают немалую нагрузку на видеокарту.

Семейство Battlefield недавно получило уже третью итерацию, позволяющую геймерам сражаться друг с другом на масштабных аренах. В игре можно выбирать бойцов разной специализации, воевать с помощью реалистично смоделированного оружия и техники. Добавьте к этому мощный движок Frostbite 2 (DX11), обеспечивающий глубокое погружение в игру. Благодаря продвинутой системе совершенствований, достижений и роста персонажа интерес к игре не будет ослабевать в течение долгого времени, добавьте к этому возможность разблокирования оружия и гаджетов. Так что длительное наслаждение третьей игрой в семействе Battlefield гарантировано.

Разработчиков Crysis можно поблагодарить за то, что их игра стала тестом де-факто графических возможностей ПК. Движок Cry Engine всегда отличался тем, что мог "поставить на колени" даже новейшие high-end системы. Именно по этой причине для наших тестов мы взяли дополнение Crysis Warhead. Мы запускали Crysis в режиме DirectX 10 с максимальным уровнем детализации.

Игра Crysis 2 на основе CryEngine 3 (DX11) переносит игрока в пост апокалиптический Нью-Йорк. Раса чужих под названием "цефы", знакомая по первой части игры, во второй части вновь пытается уничтожить человечество. Главный персонаж с позывным Алькатрас вновь оказывается в гуще событий, ему придётся надеяться только на свой нанокостюм, обеспечивающий возможности супермена, а также на оружие. Игроку как и раньше противостоят превосходящие силы врага. В отличие от первой игры, владельцы "слабых" компьютеров тоже получат плавную игру благодаря опциональному режиму DirectX 9. Разработчики пошли на некоторый технический компромисс, что связано и с портированием игры под приставки. Так что для современного "железа" игра оказывается уже не такой "тяжелой".

Действие пятой игры в семействе The Elder Scrolls разворачивается в провинции Skyrim. Сюжет игры построен вокруг возвращения драконов, что было предсказано в древних свитках ("Elder Scrolls"). Геймер играет роль "довакина", то есть персонажа с телом человека и душой дракона. В игре вам предстоит сражаться не только с обычными тварями, но и с драконами. Добавим к этому реалистичные улицы и захватывающие дух пейзажи, уходящие в горизонт. Благодаря отличной детализации растительности и значительной дальности видимости Skyrim может нагрузить любую видеокарту.

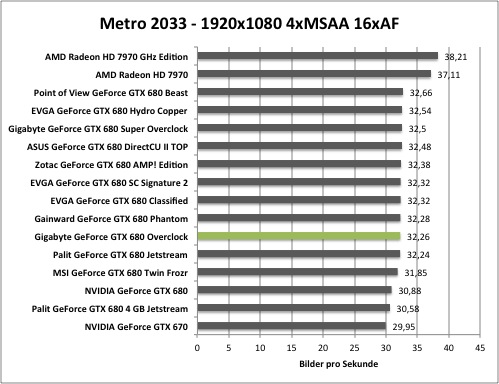

Враждебное окружение, радиация, мутанты и наёмники - все эти элементы бывший разработчик игры S.T.A.L.K.E.R. 4A Games Studios перенёс и во вселенную Metro 2033. В 2013 году человечество вновь погрязло в войне и почти что уничтожило всё живое ядерными бомбардировками. Небольшие группы выживших спустились в московское метро, чтобы укрыться. К сожалению, подземку заселили не только они, поэтому выжившим придётся сражаться с тварями, привыкшими к токсичным условиям. Причём цель этих тварей заключается в уничтожении оставшихся людей! В игре вы можете использовать как грубую силу, так и хитроумную тактику, но вам придётся нелегко. Как и в случае дебютной игры, разработчики смогли "поставить на колени" даже самые современные видеокарты движком A4 (DX11).

Gigabyte предлагает видеокарту GV-N680OC-4GD не с таким мощным разгоном, как у версии Super Overclock. Это видно по довольно скромным штатным частотам. В любом случае, мы попытались разогнать видеокарту по максимуму. Для этого мы, как обычно, выставили планку Power Limit на максимум, а также подняли напряжение до максимально допустимого уровня 1,175 В.

Мы смогли получить частоту GPU на уровне 1152 МГц. С учётом штатных частот, данный уровень разгона можно назвать хорошим. Впрочем, видеокарты других производителей и даже некоторые собственные модели Gigabyte разгоняются чуть лучше. По памяти мы получили привычную планку по разгону до 1700 МГц.

Повышение частоты GPU и памяти повлияло на производительность следующим образом:

Конечно, разгон повлиял на энергопотребление, температуру и уровень шума:

Энергопотребление всей системы под нагрузкой, Вт.

Температура под нагрузкой, градусы Цельсия.

Уровень шума под нагрузкой, дБ(А).

Видеокарта Gigabyte GV-N680OC-4GD претендует на роль универсальной модели, способной удовлетворить потребности практически любого пользователя. Но скромным заводским разгоном и альтернативной системой охлаждения сегодня никого не удивишь. Поэтому из списка преимуществ можно смело вычеркнуть производительность. Среди других видеокарт GeForce GTX 680 новинка Gigabyte по производительности находится в нижней трети. Тактовая частота GPU 1072 МГц выше эталонного уровня, но у других видеокарт она выше. В общем, результаты Gigabyte GeForce GTX 680 OC по производительности выше эталонного уровня, но по сравнению с другими видеокартами она не блещет.

Переходим ко второму параметру - охлаждению. Кулер Gigabyte WindForce в том или ином виде используется на многих видеокартах GeForce этого производителя (если не на всех). Но часто мы получаем слишком агрессивный профиль работы вентилятора, который приводит к чрезмерно высокому уровню шума. В случае GV-N680OC-4GD произошли изменения в лучшую сторону. Мы отметили приятно низкие температуры в режиме бездействия и под нагрузкой. Так что потенциал системы охлаждения сразу же заметен. Убедил нас и уровень шума. Достойно конкурировать по уровню шума может только модель MSI с кулером TwinForce, хотя по производительности охлаждения он чуть слабее. Как нам кажется, Gigabyte удалось найти отличный компромисс между скоростью и температурой.

{jphoto image=29601}

Наша модель Gigabyte GeForce GTX 680 OC с кодовым названием GV-N680OC-4GD оснащена 4 Гбайт видеопамяти. Данный шаг имеет свои преимущества и недостатки. Большинство пользователей вряд ли заметят какой-либо эффект от удвоения объёма видеопамяти. Даже на самом высоком разрешении 2560x1600 в наших тестах подобный объём памяти не требуется. Преимущества 4 Гбайт видеопамяти начинают проявляться в режиме 3D Vision Surround с разрешением 5760x1080 пикселей (см. наши тесты), но и тогда отличия невелики. Только включение сглаживания Super-Sampling Anti-Aliasing в Skyrim позволило ощутить преимущества 4 Гбайт памяти. Конечно, можно искусственно создать множество подобных сценариев. Но, повторимся, в "повседневных играх", когда геймер не пользуется специальными модами и расширенными режимами, 4 Гбайт памяти не нужны.

Что касается цены, то видеокарта Gigabyte GeForce GTX 680 OC с 4 Гбайт видеопамяти обойдётся в Европе от 489 евро, а в России - от 18,3 тыс. рублей. Если вы можете обойтись без 2 Гбайт дополнительной видеопамяти, то видеокарту можно приобрести чуть дешевле - от 422 евро в Европе или от 16,7 тыс. рублей в России. Если вы хотите приобрести очень тихую видеокарту GeForce GTX 680, то можете брать любую из перечисленных по вашему усмотрению.

Преимущества Gigabyte GV-N680OC-4GD:

- Достаточная производительность для всех современных игр

- Низкие температуры

- Низкий уровень шума в режиме бездействия и под нагрузкой

- PCI-Express 3.0

- DirectX 11.1

Недостатки Gigabyte GV-N680OC-4GD:

- Умеренный заводской разгон

- Высокая цена 4-Гбайт видеокарты