Если вы исследовали возможности генерации текста, перевода, создания кода через искусственный интеллект и модели Large Language Models (LLM), то наверняка знакомы с потенциалом технологии, а также с ограничениями. Одно из ограничений заключается в том, что на данный момент системы могут нести различный бред, который мало совпадает с фактами.

Если вы исследовали возможности генерации текста, перевода, создания кода через искусственный интеллект и модели Large Language Models (LLM), то наверняка знакомы с потенциалом технологии, а также с ограничениями. Одно из ограничений заключается в том, что на данный момент системы могут нести различный бред, который мало совпадает с фактами.

В экстремальных случаях персоналиям приписывались преступления, которые они никогда не совершали. И если подобные сведения появятся в публичном доступе, то бороться с подобной дезинформацией будет очень сложно. Если попросить ChatGPT сделать аннотацию по какой-либо книге, то результат может быть сгенерирован по книге, которой никогда не существовало.

Модели LLM будут и дальше совершенствоваться в техническом плане, однако не менее важно сделать так, чтобы в ответах искусственного интеллекта было как можно меньше фантазий, дабы не приходилось перепроверять каждый преподносимый факт. Ложных фактов быть не должно, как и придуманного контента. Возможно, бред является неотъемлемой составляющей подобных систем искусственного интеллекта, как следствие длительных процессов тренировки.

Вокруг систем искусственного интеллекта возникает все больше различных сервисов, вместе с тем компании и разработчики пытаются бороться с ложной выдаваемой информацией. Например, можно подать два слегка модифицированных запроса и провести автоматическую проверку фактов на основе сравнения ответов. Впрочем, здесь требуются дополнительные усилия, и в случае сервиса, который обрабатывает многие сотни и тысячи запросов, такое вряд ли возможно.

NVIDIA сегодня является одним из лидеров по аппаратным компонентам для тренировки и инференса подобных систем ИИ. Как и в случае CUDA, компания желает установить собственные стандарты и предложить платформу, которая поможет разрабатывать программное обеспечение.

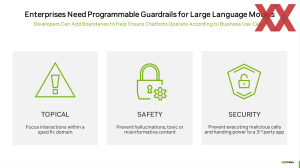

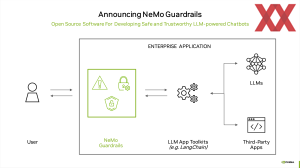

Сегодня была представлена платформа NeMo Guardrails на основе открытого исходного кода, которая призвана ограничить взаимодействие с чат-ботами определенными рамками. С одной стороны, она предотвратит выдачу некорректных ответов искусственного интеллекта. С другой стороны, она будет защищать такую систему на входе, чтобы пользователи не подавали некорректные запросы.

Систему можно представить как «черный список», в котором перечислены определенные темы, запрещенные как к выдаче, так и к подаче. Запросы, подпадающие под темы «черного списка», не будут отправлены в модель LLM. Если же искусственный интеллект выдал неподобающую информацию, то NeMo Guardrails ее заблокирует, пользователь ответ не получит. Схожая механика может использоваться, чтобы предотвратить общение с чат-ботом по определенным темам.

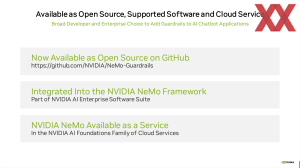

Платформа NeMo Guardrails опирается на открытый исходный код, чтобы в ней было проще находить ошибки. Корпоративные пользователи смогут задействовать платформу NeMo Guardrails в рамках Enterprise Software Suite от NVIDIA.

Предотвращение выдачи бреда и проверка фактов – серьезные проблемы, стоящие на пути дальнейшей разработки современных систем искусственного интеллекта. Но пока что приходится использовать подобные «костыли» при взаимодействии с пользователем вместо того, чтобы сразу тренировать системы на противодействие бреду и ложным фактам. Проблема здесь есть, и в будущем ее придется решать. А пока что можно воспользоваться помощью NVIDIA в виде NeMo Guardrails.

NeMo Guardrails можно скачать на GitHub.

Подписывайтесь на группу Hardwareluxx ВКонтакте и на наш канал в Telegram (@hardwareluxxrussia).