Чуть больше недели назад мы получили посылку от NVIDIA, в которой находился ломик-гвоздодёр. Если данный шаг подразумевался как первый аккорд в грядущем анонсе GeForce GTX 690, то PR-отдел Nvidia - просто молодцы. Удивительно, но наперекор своим традициям Nvidia на своём мероприятии в Шанхае приоткрыла завесу тайны над видеокартой GeForce GTX 690 даже раньше NDA, причём привела технические спецификации. Конечно, по поводу GeForce GTX 690 ходили бесчисленные слухи, но Nvidia выбрала такой оригинальный "выход с ломиком". Между тем наша тестовая лаборатория уже получила образец GeForce GTX 690, с результатами тестов которого вы сможете ознакомиться в статье.

Чуть больше недели назад мы получили посылку от NVIDIA, в которой находился ломик-гвоздодёр. Если данный шаг подразумевался как первый аккорд в грядущем анонсе GeForce GTX 690, то PR-отдел Nvidia - просто молодцы. Удивительно, но наперекор своим традициям Nvidia на своём мероприятии в Шанхае приоткрыла завесу тайны над видеокартой GeForce GTX 690 даже раньше NDA, причём привела технические спецификации. Конечно, по поводу GeForce GTX 690 ходили бесчисленные слухи, но Nvidia выбрала такой оригинальный "выход с ломиком". Между тем наша тестовая лаборатория уже получила образец GeForce GTX 690, с результатами тестов которого вы сможете ознакомиться в статье.

На мероприятии NVIDIA Gaming Festival 2012 в Шанхае (Китай) Джен-Хсун Хуанг (Jen-Hsun Huang), главный исполнительный директор Nvidia, лично представил видеокарту GeForce GTX 690. Весь процесс вы можете посмотреть на 20-минутном ролике ниже:

GeForce GTX 690 - первая видеокарта Nvidia на двух GPU, базирующаяся на новой архитектуре "Kepler". Она использует два графических процессора GK104, то есть GeForce GTX 690 можно рассматривать как "бутерброд" из двух видеокарт GeForce GTX 680, правда, на одной плате. Если вам интересны подробности по поводу архитектуры Kepler, то мы рекомендуем обратиться к нашей статье и тестам GeForce GTX 680. Ниже мы рассмотрим детали новой видеокарты GeForce GTX 690.

В Европе уже появились первые видеокарты по цене 829 евро. Так что стартовый уровень цен должен быть ниже отметки 1000 евро. Сама Nvidia рекомендует цену 35 999 рублей для России и 9 899 гривен для Украины.

Технические спецификации приведены в следующей таблице:

| NVIDIA GeForce GTX 680 | NVIDIA GeForce GTX 690 | |

| Розничная цена | около 475 евро в Европе 18,3 тыс. рублей в России |

около 999 евро в Европе |

| Сайт производителя | Страница продукта NVIDIA | Страница продукта NVIDIA |

| Технические спецификации | ||

|---|---|---|

| GPU | GK104 | 2x GK104 |

| Техпроцесс | 28 нм | 28 нм |

| Число транзисторов | 3,54 млрд. | 2x 3,54 млрд. |

| Тактовая частота GPU | 1006 МГц + Boost (1058 МГц) | 915 МГц + Boost (1019 МГц) |

| Тактовая частота памяти | 1502 МГц | 1502 МГц |

| Тип памяти | GDDR5 | GDDR5 |

| Объём памяти | 2048 Мбайт | 2x 2048 Мбайт |

| Ширина шины памяти | 256 бит | 2x 256 бит |

| Пропускная способность памяти | 192,2 Гбайт/с | 192,2 Гбайт/с |

| Версия DirectX | 11.1 | 11.1 |

| Потоковые процессоры | 1536 (1D) | 2x 1536 (1D) |

| Текстурные блоки | 128 | 2x 128 |

| ROP | 32 | 2x 32 |

| Пиксельная скорость заполнения | 32,2 Гпиксель/с | 2x 29,3 Гпиксель/с |

| Минимальное энергопотребление | 15 Вт | 15 Вт |

| Максимальное энергопотребление | 195 Вт | 300 Вт |

| SLI/CrossFire | SLI | SLI |

Для GeForce GTX 590 NVIDIA пошла на снижение тактовой частоты GPU с 772 до 608 МГц, что составляет чуть больше 21 процента. Архитектурные детали не изменились, то есть видеокарта предлагает два полноценные GPU Fermi. Что касается памяти, то Nvidia решила снизить частоту 1002 МГц до уровня 854 МГц - почти на 15 процентов. Для новой видеокарты GeForce GTX 690 NVIDIA постаралась лучше соответствовать конфигурации их двух GTX 680 в SLI. NVIDIA снизила тактовую частоту до 915 МГц, но по сравнению с начальной планкой 1006 МГц мы получили замедление всего на девять процентов. Частота памяти была оставлена прежней - 1502 МГц. Всё это позволило Nvidia заявить о практически полной производительности двух графических процессоров GeForce GTX 680. Конечно, всё это стало возможным благодаря более эффективной архитектуре GPU и меньшему техпроцессу. Во многих обзорах отмечалось, что GeForce GTX 680 работает намного эффективнее поколения "Fermi".

Впрочем, NVIDIA всё равно пришлось смириться с наличием двух GPU, поэтому тепловой пакет (TDP) GeForce GTX 690 был увеличен до 300 Вт. Видеокарта GeForce GTX 590, напомним, была выпущена с тепловым пакетом (TDP) 365 Вт, а у AMD Radeon HD 6990 тепловой пакет составлял все 375 Вт (450 Вт в режиме OC). Для обеспечения питания у GeForce GTX 690 используются два 8-контактных гнезда, которые способны подавать вместе со слотом PCI Express более чем 375 Вт энергии. Если для GeForce GTX 680 была достаточна 4-фазная система питания, то в данном случае NVIDIA GeForce GTX использует 10-фазную систему питания для GPU (пять фаз на GPU и по одной на память), то есть мы получаем питание 10+2.

С помощью технологии "GPU Boost"оба GPU видеокарты могут увеличивать тактовую частоту, по крайней мере, до планки 1019 МГц, то есть почти в два раза больше в абсолютном значении, чем составляет прирост у GeForce GTX 680. В некоторых тестах мы даже зафиксировали прирост тактовой частоты до 1071 МГц. Но NVIDIA урезала максимальный порог "Power Target", его можно выставлять только на прирост в 35 процентов. Заявленные 300 Вт теплового пакета соответствуют энергопотреблению с полным приростом Boost. При работе на штатных тактовых частотах 915 МГц видеокарта потребляет 263 Вт, то есть "Power Target" составляет около 405 Вт.

Ниже мы детально рассмотрим новую видеокарту GeForce GTX 690.

Как мы упомянули во введении, NVIDIA решила сделать объявление GeForce GTX 690 запоминающимся. Примерно за неделю до объявления видеокарты наши редакторы получили ломик-гвоздодёр, а несколько дней назад в редакцию пришел деревянный ящик, открыть который как раз можно с помощью ломика. Розничные версии видеокарты, конечно, не будут поставляться в столь хитроумной упаковке - вы получите стандартную картонную коробку.

На ящике присутствуют различные надписи и цифры. "0b" соответствует двоичному коду, а двоичное число "1010110010" как раз соответствует "690" в десятичной системе счисления. Другие цифры и числа мы пока не смогли расшифровать.

Как видно на фотографии, видеокарта использует кулер с одним осевым вентилятором диаметром 85 мм. Длина видеокарты GeForce GTX 690 составляет около 28 см - это примерно соответствует старой доброй GeForce GTX 590. Если быть точным, то 11 дюймов соответствуют 27,94 см, то есть спецификации ATX. По сравнению с 12-дюймовой (30,5 см) видеокартой AMD Radeon HD 6990 новинка Nvidia действительно более компактна. В ближайшие недели мы узнаем, сколько места потребуется для установки AMD Radeon HD 7990.

Сзади печатная плата напоминает собой симбиоз GeForce GTX 590 и 680. Слева и справа можно наблюдать места расположения GPU. Между ними находится подсистема питания, которую мы чуть позже детально рассмотрим.

Центрально размещенный 85-вентилятор GeForce GTX 690 радует своей тихой работой. Следует отметить, что оптимизированная конструкция кулера Nvidia позволила говорить о меньшем уровне шума по сравнению с двойкой GeForce GTX 680 в SLI. Важную роль здесь играет, например, угол наклона лопастей вентилятора. Да и Nvidia улучшила алгоритм управления вентилятором. Он теперь не "взлетает" неожиданно в моменты нагрузки, скорость плавно регулируется как функция температуры.

За вентилятором располагается радиатор с пластиной, накрывающей компоненты печатной платы. Воздух продувается через рёбра, расположенные по обе стороны от вентилятора - для этой цели Nvidia создала специальные воздуховоды, накрыв радиаторы крышкой из оргстекла.

Слева и справа от вентилятора за крышкой из оргстекла можно заметить алюминиевые рёбра охлаждения. Световая подсветка усилила бы визуальный эффект от видеокарты, пусть даже подобный моддинг будет интересен не каждому.

Кроме того, можно рассмотреть и магниевый кожух, в который заключен вентилятор и радиаторы. Выбор подобного сплава, как обещает Nvidia, обеспечивает лучшую теплопроводность, меньший вес и лучшую изоляцию от шума.

Питание на видеокарту GeForce GTX 690 подается через слот PCI Express и два 8-контактных гнезда, расположенных сзади видеокарты на верхней панели. Каждое гнездо способно принимать 150 Вт энергии, в результате чего видеокарта может потреблять до 375 Вт в общей сложности. Конечно, многие производители блоков питания позволяют подавать через 8- или 6-контактные вилки мощность больше 150 или 75 Вт, соответственно, так что пространство для маневра остаётся.

По центру вентилятора сверху располагается логотип GeForce GTX, который подсвечивается во время работы видеокарты. Конечно, в закрытом корпусе этот эффект уже будет не виден, однако он ничему не помешает.

Разъем SLI позволяет объединить две видеокарты GeForce GTX 690 в конфигурацию Quad SLI. Конечно, при случае мы постараемся протестировать подобную сборку Quad SLI.

На задней панели печатной платы можно разглядеть любопытные детали о видеокарте. Например, компоненты подсистемы питания - стабилизаторы напряжения. Nvidia использовала 10-слойную печатную плату, которая содержит, в общей сложности, 62 грамма меди. Подобное количество дорогого металла позволяет улучшить отведение тепла от горячих компонентов в различных слоях платы.

При объявлении нового поколения GPU "Kepler" NVIDIA увеличила количество поддерживаемых дисплеев. Однако из-за ограниченного пространства на слотовой заглушке ввода/вывода мы получаем только 2x двухканальных выхода DVI-I, 1x двухканальный DVI-D и выход mini DisplayPort. Честно говоря, вместо одного порта DVI производитель мог бы установить полноразмерный выход DisplayPort или HDMI.

После установки видеокарты, если приглушить свет в помещении, то можно заметить красивую подсветку логотипа GeForce GTX.

На иллюстрации мы привели сравнение видеокарты GeForce GTX 590 (внизу) и GeForce GTX 690 (вверху). Длина видеокарт и базовый принцип охлаждения идентичны. Но, конечно, главные отличия кроются в разных GPU и т.д.

Без массивного кулера печатная плата кажется уже не такой внушительной. Nvidia, в частности, пришлось использовать 10-слойную печатную плату из-за большого числа компонентов. Слева и справа можно видеть GPU0 и GPU1, а между ними - подсистему питания карты.

Вокруг GPU расположены восемь чипов памяти GDDR5, каждый ёмкостью 256 Мбайт. Рядом с первым GPU находится коммутатор PCI Express производства PLX.

За питание каждого графического процессора отвечают пять фаз. Восемь чипов памяти питаются через дополнительную фазу, так что видеокарта обеспечивает 10 +2 фазную систему питания для GPU/памяти.

Для соединения двух GPU используется коммутатор NVIDIA PEX 8747 производства PLX Technology. Он представляет собой чип PCI Express 3.0 с поддержкой 48 линий. По 16 линий выделяются для обоих графических процессоров и слота интерфейса с системой.

Из-за перехода на PCI Express 3.0 NVIDIA отказалась от использования собственного чипа NF200. PEX 8747 может работать с числом портов PCI Express до пяти в разных конфигурациях и потребляет, по данным производителя до восьми ватт энергии. Если вам интересна более подробная информация о данном чипе, то мы рекомендуем обратиться на сайт производителя.

На видеокарту установлено по восемь чипов памяти GDDR5 на каждый GPU. Чипы произведены Samsung - у той же GeForce GTX 680 используются чипы от Hynix. Память Samsung K4G20325FC по спецификациям работает от напряжения 1,5 В с частотой 1500 МГц.

Кулер состоит из цельной металлической пластины, которая накрывается кожухом из магниевого сплава - внутри установлен вентилятор и два радиатора. Расположение GPU, чипов памяти и других компонентов хорошо видно по установленным теплопроводящим прокладкам.

Как можно видеть, для охлаждения GPU Nvidia использовала испарительную камеру. Она передаёт тепло на радиаторы - на фотографии видны и рёбра охлаждения.

Для проведения тестирования мы обновили нашу тестовую систему, а также и поколение драйверов. Процессор Intel Core i7-3960X был разогнан со штатной частоты 3,2 ГГц до 4,2 ГГц, чтобы максимально устранить "узкое место" по производительности CPU. Мы использовали следующие компоненты:

| Тестовая конфигурация | |

|---|---|

| Процессор | Intel Core i7-3960X 3,3 ГГц разгон до 4,2 ГГц |

| Материнская плата | ASUS P9X79 |

| Память | ADATA XPG Gaming Series Low Voltage 4x 2 Гбайт PC3-12800U CL 9-9-9-24 |

| Накопитель | ADATA S510 SSD 60 Гбайт |

| Блок питания | Seasonic Platinum Series 1000 Вт |

| Операционная система | Windows 7 64 Bit с SP1 |

| Видеокарты | |

| NVIDIA | NVIDIA GeForce GTX 690 (915/1502 МГц, 4096 Мбайт) |

| NVIDIA GeForce GTX 680 (1006/1502 МГц, 2048 Мбайт) | |

| NVIDIA GeForce GTX 590 (608/1215/854 МГц, 3072 Мбайт - 1536 Мбайт эффективное значение) | |

| NVIDIA GeForce GTX 580 (772/1544/1000 МГц, 1536 Мбайт) | |

| NVIDIA GeForce GTX 570 (732/1464/950 МГц, 1280 Мбайт) | |

| NVIDIA GeForce GTX 560 Ti 448 Cores (732/1464/950 МГц, 1280 Мбайт) | |

| NVIDIA GeForce GTX 560 Ti (820/1640/1000 МГц, 1024 Мбайт) | |

| NVIDIA GeForce GTX 560 (810/1620/1002 МГц, 1024 Мбайт) | |

| NVIDIA GeForce GTX 550 Ti (900/1800/1026 МГц, 1024 Мбайт) | |

| AMD | AMD Radeon HD 7970 (925/925/1375 МГц, 3072 Мбайт) |

| AMD Radeon HD 7950 (800/800/1250 МГц, 3072 Мбайт) | |

| AMD Radeon HD 7870 (1000/1000/1200 МГц, 2048 Мбайт) | |

| AMD Radeon HD 7850 (860/860/1200 МГц, 2048 Мбайт) | |

| AMD Radeon HD 7770 (1000/1000/1125 МГц, 1024 Мбайт) | |

| AMD Radeon HD 7750 (800/800/1125 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6990 (830/830/1250 МГц, 4096 Мбайт - 2048 Мбайт эффективное значение) | |

| AMD Radeon HD 6970 (880/880/1375 МГц, 2048 Мбайт) | |

| AMD Radeon HD 6950 (800/800/1200 МГц, 2048 Мбайт) | |

| AMD Radeon HD 6870 (900/900/1050 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6850 (775/775/1000 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6790 (840/840/1050 МГц, 1024 Мбайт) | |

| AMD Radeon HD 6770 (850/850/1200 МГц, 1024 Мбайт) | |

| Драйверы: | |

| NVIDIA | GeForce 301.33 WHQL |

| AMD | Catalyst 12.3 Preview |

Компоненты для нашей тестовой системы были предоставлены ASUS, Intel, Thermaltake и Seasonic. Мы выражаем благодарность данным компаниям за предоставленные компоненты!

Настройки драйверов NVIDIA:

- Текстурная фильтрация: Качество

- Сглаживание- гамма-коррекция: Да

- Текстурная фильтрация - оптимизация анизотропии: Нет

- Текстурная фильтрация - отрицательный LOD Bias: Заблокировано

Текстурные настройки AMD:

- Текстурная фильтрация: Качество

- Catalyst AI: Выключен/ Качество

Ниже приведены настройки тестов, использованных нами:

Futuremark 3DMark 11 (DX11):

- Entry

- Performance

- Extreme

LuxMark 2.0 (OpenCL):

- Sala

Anno 2070 (DX11):

- 1680x1050 AA без 16xAF

- 1680x1050 MLAA 16xAF

- 1920x1080 AA без 16xAF

- 1920x1080 MLAA 16xAF

- 2560x1600 AA без 16xAF

- 2560x1600 MLAA 16xAF

Battlefield 3 (DX11):

- 1680x1050 1xAA 16xAF

- 1680x1050 4xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 4xAA 16XAF

- 2560x1600 1xAA 16xAF

- 2560x1600 4xAA 16xAF

Call of Duty: Modern Warfare 3 (DX9):

- 1680x1050 4xAA 16xAF

- 1920x1080 4xAA 16xAF

- 2560x1600 4xAA 16xAF

Crysis Warhead (DX10):

- 1680x1050 1xAA 16xAF

- 1680x1050 8xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 8xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 8xAA 16xAF

Crysis 2 (DX11):

- 1680x1050 1xAA 16xAF

- 1680x1050 16xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 16xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 16xAA 16xAF

Rage (OpenGL):

- 2560x1600 8xAA 16xAF

The Elder Scrolls V: Skyrim (DX9):

- 1680x1050 1xAA 16xAF

- 1680x1050 8xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 8xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 8xAA 16xAF

The Witcher 2 (DX9):

- 1680x1050 AA без 16xAF

- 1680x1050 MLAA 16xAF

- 1920x1080 AA без 16xAF

- 1920x1080 MLAA 16xAF

- 2560x1600 AA без 16xAF

- 2560x1600 MLAA 16xAF

Metro 2033 (DX11):

- 1680x1050 1xAA 16xAF

- 1680x1050 4xAA 16xAF

- 1920x1080 1xAA 16xAF

- 1920x1080 4xAA 16xAF

- 2560x1600 1xAA 16xAF

- 2560x1600 4xAA 16xAF

Мы начнем наши тесты, как обычно, с измерения энергопотребления:

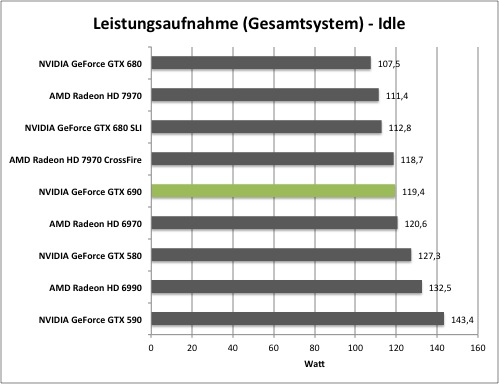

Энергопотребление всей системы в режиме бездействия, Вт.

По результатам конфигурации SLI из двух GeForce GTX 680 хорошо видно, что Nvidia значительно улучшила эффективность энергопотребления GPU "Kepler" в режиме бездействия. Для GeForce GTX 690 мы получили примерно на семь ватт большее энергопотребление, чем для системы SLI. Впрочем, по сравнению с GeForce GTX 590 мы всё равно наблюдаем заметный прогресс.

Энергопотребление всей системы под нагрузкой, Вт.

Системы из двух GPU Radeon HD 7970 или GeForce GTX 680, да и предыдущая модель GeForce GTX 590 потребляют энергии больше "магической планки" 500 Вт под нагрузкой. Вместе с тем в случае GeForce GTX 690 энергопотребление составляет всего 470 Вт - хороший результат. С другой стороны, его можно будет назвать отличным только при высоком уровне производительности.

Температура в режиме бездействия, градусы Цельсия.

Нас приятно удивили низкие температуры обоих GPU видеокарты GeForce GTX 690 в режиме бездействия. Разница между двумя чипами составляла, максимум, два градуса Цельсия. Для своего эталонного дизайна Nvidia действительно отобрала лучшие чипы, и это видно.

Температура под нагрузкой, градусы Цельсия.

Даже под нагрузкой GeForce GTX 690 не так сильно нагревается, как видеокарты с двумя GPU предыдущего поколения. Результаты Radeon HD 6990 и GeForce GTX 590 оказываются близки, но не следует забывать о значительном уровне шума. В данном случае оба чипа GeForce GTX 690 работали с одинаковой температурой.

Уровень шума в режиме бездействия, дБ(А).

Нас давно интересовали результаты GeForce GTX 690 по уровню шума. Всё же в данном отношении видеокарта с двумя GPU предыдущего поколения отнюдь не радовала. И у GeForce GTX 690 мы действительно получаем отличную работу вентилятора новой системы охлаждения NVIDIA. Уровень шума в режиме бездействия составил всего 35,4 дБ(A), тише работала только эталонная видеокарта GeForce GTX 680 - даже Radeon HD 7970 оказалась чуть громче. Хотя разница по сравнению с двумя видеокартами GeForce GTX 680 в SLI не такая и большая - они тоже работают довольно тихо.

Уровень шума под нагрузкой, дБ(А).

Под нагрузкой уровень шума предсказуемо увеличился, но отличная позиция GeForce GTX 690 не изменилась. Видеокарта шумит на уровне других моделей с одним GPU - честно говоря, результат неожиданно приятный. Мы получили действительно меньший уровень шума по сравнению с конфигурациями на двух видеокартах GeForce GTX 680 и Radeon HD 7970, а также и моделями с двумя GPU GeForce GTX 590 и Radeon HD 6990.

Мы добавили в наши тесты последнее поколение 3DMark. 3DMark 11 является первым тестом, полностью ориентированным на DirectX 11, от разработчика Futuremark. Именно по этой причине тест интенсивно использует тесселяцию, глубину поля резкости, объёмное освещение и DirectCompute. Вполне логичным кажется требование по наличию многоядерного процессора с количеством ядер не меньше четырёх. Скачать тест можно в соответствующем разделе нашего сайта.

AMD и NVIDIA всегда подчёркивают вычислительную производительность своих GPU. И в дополнение к многочисленным движкам с поддержкой OpenCL, мы также решили оценить вычислительную производительность отдельно. Мы взяли тест LuxMark 2.0, тестовую сцену "Sala" с использованием RayTracing, результат теста выводится в сэмплах в секунду.

Скачать LuxMark 2.0 вы можете бесплатно по следующей ссылке.

Во второй части знаменитой ролевой саги "Ведьмак/The Witcher" Геральту из Ривии снова противостоят полчища тварей. С помощью меча и магии игроку предстоит пройти многочисленные локации фантастического игрового мира, радующего вниманием к деталям. Вторая часть игры под названием "Убийца королей/Assassins of Kings" стала успешным продолжением первой игры в развитии нелинейного сюжета, когда действия игрока влияют на ход игры. Игра вышла в 2010 году, и специально разработанный для неё Red Engine (DX9) смог поднять стандарты качества графики ролевых игр на новую планку. Геймеры и журналисты с одобрением встретили новую игру. И разработчики движка RED, компания CD Projekt, не зря назвали свой движок "лучшим в мире для ролевых игр".

Игра Call of Duty - Modern Warfare 3, вышедшая в конце 2011 года, стала восьмой в весьма успешном семействе. Шутер от первого лица позволяет насладиться активным геймплеем в реальном режиме времени, который перемежается с сюжетными вставками кинематографического качества. Геймер погружается в брутальную атмосферу игры благодаря богатым возможностям движка IW Engine 4.0 (DX9), оказываясь в гуще боевых событий. Если верить разработчикам, движок отличается от конкурирующих решений возможностью вертикального геймплея и проработанными детализованными текстурами.

Игра Anno 2070 отличается от предшествующих игр серии тем, что действие происходит не в прошлом, а через 60 лет в будущем. Геймплей во многом похож, то есть вам нужно исследовать и открывать острова, колонизировать их, создавать циклы производства продукции и развития поселений, чтобы удовлетворять потребности общества, а также выстраивать дипломатические отношения с соседями. В игру были введены три фракции: Эко/Eco нацеливаются на развитие возобновляемых источников энергии и сохранение природы, Магнаты/Tycoons не стесняются загрязнять окружающую среду ради прибыльной работы тяжелой промышленности. Третья фракция Техи/Techs развивают новые технологии и осваивают морские глубины. Большие острова, живая флора и фауна, впечатляющие эффекты воды и растительности - всё это в изобилии имеется в игре благодаря движку Related Designs (DX11), и высокие настройки детализации накладывают немалую нагрузку на видеокарту.

Семейство Battlefield недавно получило уже третью итерацию, позволяющую геймерам сражаться друг с другом на масштабных аренах. В игре можно выбирать бойцов разной специализации, воевать с помощью реалистично смоделированного оружия и техники. Добавьте к этому мощный движок Frostbite 2 (DX11), обеспечивающий глубокое погружение в игру. Благодаря продвинутой системе совершенствований, достижений и роста персонажа интерес к игре не будет ослабевать в течение долгого времени, добавьте к этому возможность разблокирования оружия и гаджетов. Так что длительное наслаждение третьей игрой в семействе Battlefield гарантировано.

Разработчиков Crysis можно поблагодарить за то, что их игра стала тестом де-факто графических возможностей ПК. Движок Cry Engine всегда отличался тем, что мог "поставить на колени" даже новейшие high-end системы. Именно по этой причине для наших тестов мы взяли дополнение Crysis Warhead. Мы запускали Crysis в режиме DirectX 10 с максимальным уровнем детализации.

Игра Crysis 2 на основе CryEngine 3 (DX11) переносит игрока в пост апокалиптический Нью-Йорк. Раса чужих под названием "цефы", знакомая по первой части игры, во второй части вновь пытается уничтожить человечество. Главный персонаж с позывным Алькатрас вновь оказывается в гуще событий, ему придётся надеяться только на свой нанокостюм, обеспечивающий возможности супермена, а также на оружие. Игроку как и раньше противостоят превосходящие силы врага. В отличие от первой игры, владельцы "слабых" компьютеров тоже получат плавную игру благодаря опциональному режиму DirectX 9. Разработчики пошли на некоторый технический компромисс, что связано и с портированием игры под приставки. Так что для современного "железа" игра оказывается уже не такой "тяжелой".

Действие пятой игры в семействе The Elder Scrolls разворачивается в провинции Skyrim. Сюжет игры построен вокруг возвращения драконов, что было предсказано в древних свитках ("Elder Scrolls"). Геймер играет роль "довакина", то есть персонажа с телом человека и душой дракона. В игре вам предстоит сражаться не только с обычными тварями, но и с драконами. Добавим к этому реалистичные улицы и захватывающие дух пейзажи, уходящие в горизонт. Благодаря отличной детализации растительности и значительной дальности видимости Skyrim может нагрузить любую видеокарту.

Враждебное окружение, радиация, мутанты и наёмники - все эти элементы бывший разработчик игры S.T.A.L.K.E.R. 4A Games Studios перенёс и во вселенную Metro 2033. В 2013 году человечество вновь погрязло в войне и почти что уничтожило всё живое ядерными бомбардировками. Небольшие группы выживших спустились в московское метро, чтобы укрыться. К сожалению, подземку заселили не только они, поэтому выжившим придётся сражаться с тварями, привыкшими к токсичным условиям. Причём цель этих тварей заключается в уничтожении оставшихся людей! В игре вы можете использовать как грубую силу, так и хитроумную тактику, но вам придётся нелегко. Как и в случае дебютной игры, разработчики смогли "поставить на колени" даже самые современные видеокарты движком A4 (DX11).

Zur Vollversion von Metro 2033 in unserem Preisvergleich gelangt man über diesen Link.

Эффект микро-подёргиваний для систем с несколькими GPU можно назвать горячей темой. Он виден не всем, но одно можно сказать уверенно: при сборке конфигураций на нескольких GPU приходится в той или иной степени иметь дело с микро-подергиваниями. Проблему можно решить несколькими способами. Nvidia уже дано работает над выравниванием частоты кадров в подобных конфигурациях, и в случае "Kepler" мы получаем новые улучшения.

Если карта выполняет рендеринг с частотой 30 кадров в секунду, то картинка на экран выводится каждые 33,3 мс. В системе с несколькими GPU над рендерингом работают, как минимум, два GPU. Поскольку разные кадры накладывают разную вычислительную нагрузку, то GPU тратят разное время на обработку кадра. Таким образом, картинки на экране появляются не с равными промежутками 33,3 мс, а через отрезки разного времени. Эта разница , которая может составлять считанные миллисекунды, воспринимается пользователем как микро-подергивание. Чем выше частота кадров, тем меньше шанс того, что эффект микро-подергивания проявит себя. Например, если сцена обрабатывается с частотой кадров 60 fps, то каждый кадр выводится за 16,6 мс. Следовательно, разброс по времени обработки будет существенно меньше, в результате чего и микро-подёргивания будут уже не так заметны.

NVIDIA с видеокартой GeForce GTX 690 желает "дозированно выдавать частоту кадров в секунду".

NVIDIA:

В архитектуре Kepler было добавлено аппаратное дозирование частоты кадров - то есть технология, которая позволяет минимизировать подёргивания в случае работы GeForce GTX 690. В режиме SLI два GPU разделяют нагрузку, обрабатывая последовательные кадры - один GPU работает над текущим кадром, а другой GPU - над следующим. Но если нагрузка каждого кадра отличается, то два GPU справятся с вычислениями кадров за разное время. И при выводе кадра на монитор можно будет заметить небольшие рывки.

В GeForce GTX 690 встроен механизм регулировки потока кадров. Видеокарта отслеживает и регулирует процесс вывода кадров на монитор, чтобы сгладить скорость вывода кадров и сделать её более равномерной.

Для тестов мы взяли три приложения, которые позволили нам измерить время вывода каждого кадра. Чем меньше разница во времени вывода, тем более плавной будет картинка, тем меньший эффект микро-подёргиваний мы получим.

В Crysis Warhead можно видеть заметное сглаживание частоты кадров GeForce GTX 690 по сравнению с GeForce GTX 590. Во время проведения теста микро-подёргиваний не было заметно.

В Unigine Heaven 3.0 особых оптимизаций не требуется. Между двумя видеокартами нет качественной разницы по скорости вывода кадров.

Но вот в Metro 2033 мы наблюдаем совершенно обратную картину Crysis Warhead. Как можно видеть на графике, проблема микро-подёргиваний сильнее проявляется у GeForce GTX 690, чем у видеокарты предыдущего поколения GeForce GTX 590.

Как видим, проблему микро-подёргиваний пока нельзя назвать полностью решённой, и мы будем внимательно следить за развитием ситуации. Сегодня существует два основных способа её решения. Первый заключается в выборе таких настроек качества игры, чтобы обе видеокарты могли выдавать частоту кадров не ниже 50 fps - тогда микро-подёргивания будут не так заметны. Второй подразумевает использование ограничителя частоты кадров. В случае объявления NVIDIA GeForce GTX 680 мы как раз получили подобный ограничитель в виде опции "Adaptive VSync", доступной напрямую в драйвере.

Как видно по результатам тестов, видеокарта GeForce GTX 690, как и конфигурации на нескольких GPU из видеокарт Radeon HD 7970 и GeForce GTX 680, способна полностью раскрыть свой потенциал только на высоких разрешениях и настройках качества. Поэтому мы провели дополнительные тесты с тремя мониторами с разрешением 1920x1080 каждый, что дало нам суммарное разрешение картинки 5760x1080 пикселей.

Конечно, подобное разрешение будут использовать далеко не все геймеры, но не следует забывать, что видеокарту GeForce GTX 690 тоже смогут позволить себе далеко не все. Мы провели тесты высокого разрешения в четырёх играх и сравнили результаты с видеокартами GeForce GTX 680 и Radeon HD 7970, включая конфигурации SLI и CrossFire.

В некоторых режимах производительности GeForce GTX 680 или Radeon HD 7970 уже недостаточно для плавной частоты кадров в разрешении 5760x1080. И в таких случаях помогают конфигурации SLI или CrossFire из двух видеокарт GeForce GTX 680 или Radeon HD 7970. Видеокарта GeForce GTX 690 вполне способна конкурировать с двумя GeForce GTX 680, что не удивляет.

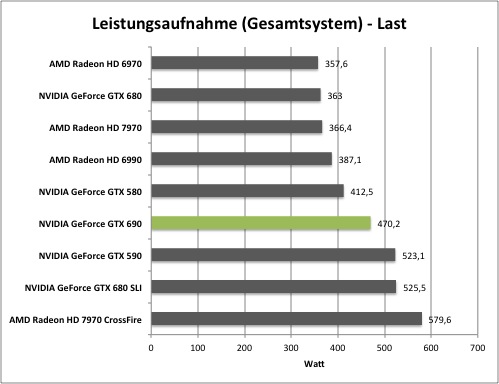

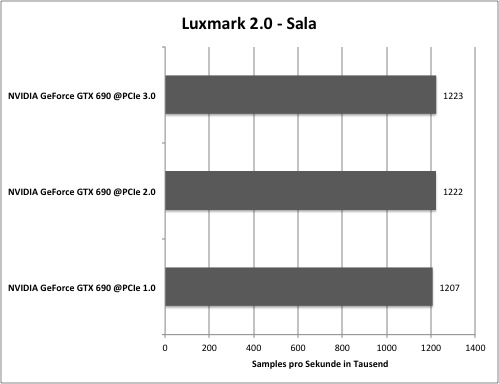

В тестах видеокарты AMD Radeon HD 7970 и NVIDIA GeForce GTX 680 показали себя как очень скоростные модели, и добавление поддержки PCI Express 3.0 не повлияло на их работу сколько-нибудь существенным образом. Отметим, что у некоторых материнских плат на чипсете X79 с видеокартой GeForce GTX 680 наблюдались сложности - она не работала с интерфейсом PCI Express 3.0 и откатывалась на стандарт 2.0. Встроенный коммутатор PEX 8747 поддерживает интерфейс PCI Express 3.0, и по умолчанию он успешно работал в наиболее скоростном режиме на нашей материнской плате ASUS P9X79.

Многие пользователи интересовались тем, повлияет ли интерфейс PCI Express 3.0 на производительность по сравнению с PCI Express 2.0. Мы провели ряд тестов, которые позволяют ответить на этот вопрос:

Как видим, по производительности установка GeForce GTX 690 на интерфейс PCI Express 3.0 не даёт какого-либо ощутимого эффекта. В случае использования стандарта PCI Express 1.0 мы наблюдаем небольшое замедление, но вряд ли кто-нибудь будет использовать топовую видеокарту в столь старой системе.

Как можно видеть в предыдущих тестах, даже разрешение 2560x1600 часто недостаточно, чтобы полностью нагрузить видеокарту GeForce GTX 690. Здесь, конечно, необходимо прибегать к помощи сглаживания методом супер-сэмплинга или мульти-сэмплинга. Мы использовали популярные игры The Elder Scrolls V Skyrim и Battlefield 3 для тестов максимальных режимов сглаживания. И в данном случае немаловажен объём доступной видеопамяти. Мы сравнивали GeForce GTX 690 с двумя моделями GeForce GTX 680, оснащёнными 4 и 2 Гбайт памяти.

В низких режимах сглаживания видеокарта GeForce GTX 690 демонстрирует себя по производительности как две видеокарты GeForce GTX 680 с 2 Гбайт памяти в режиме SLI, но после включения 4xMSAA+2 xSGSSAA мы наблюдаем проблемы из-за нехватки памяти. Вперёд выходит видеокарта GeForce GTX 680 с 4 Гбайт видеопамяти, поскольку игра занимает в памяти видеокарты 3100 Мбайт.

Впрочем, данный пример можно считать одним из экстремальных, где GeForce GTX 690 демонстрирует свои ограничения. Кроме того, всегда можно найти какие-либо тяжелые настройки, которые будут "не по зубам" Radeon HD 7970 или GeForce GTX 680. В данном случае мы наблюдаем ситуацию, когда GeForce GTX 690 упирается в объём доступной видеопамяти, не более того.

Видеокарта GeForce GTX 690 отлично справляется с охлаждением двух графических процессоров, поэтому нам было интересно посмотреть, как она отнесётся к разгону. Для этой цели мы использовали утилиту EVGA Precision Tool версии 3.0.2.

Впрочем, Nvidia добавила несколько препятствий для разгона. Как мы уже упоминали, бегунок "Power Target" можно выставлять только на уровень 135 процентов. Это соответствует теоретической мощности 405 Вт. Кроме того, Nvidia разрешает выставлять максимальный уровень напряжения на 1,175 В - его мы использовали в тесте. Теоретически GPU могут работать и от намного большего напряжения.

Мы смогли получить прирост тактовой частоты GPU Clock Offset 106 МГц. Эталонная частота составила 1021 МГц. А в режиме "GPU Boost" видеокарта работала на частотах не ниже 1125 МГц. В некоторых приложениях мы даже зафиксировали рост "GPU Boost" до уровня 1176 МГц. Память штатно работала на частоте 1502 МГц, мы смогли разогнать её до 1606 МГц.

Разгон тактовых частот привёл к следующим результатам по производительности:

Конечно, подъём тактовой частоты и напряжения привёл к росту других параметров:

Энергопотребление всей системы под нагрузкой, Вт.

Температура под нагрузкой, градусы Цельсия.

Уровень шума под нагрузкой, дБ(А).

В случае видеокарты GeForce GTX 680 (тест и обзор Hardwareluxx) Nvidia уже неплохо показала себя. Ряд недостатков поколения "Fermi", таких как высокое энергопотребление, был частично решён или полностью устранён. Видеокарта GeForce GTX 680 показала отличное соотношение производительность/энергопотребление, да и первые видеокарты с собственными системами охлаждения производителей только усилили первоначальные впечатления.

В случае видеокарты с двумя GPU Nvidia пришлось нелегко, поскольку требовалось оставаться в разумных рамках по всем параметрам. GPU GK104 уже неплохо показали себя по энергопотреблению, но Nvidia смогла ещё улучшить показатели путём тщательного отбора чипов. В результате Nvidia смогла уместить видеокарту в тепловом пакете 300 Вт. С невысокими штатными тактовыми частотами мы получаем ещё меньший уровень энергопотребления - всего 263 Вт. Подобные характеристики были ещё совсем недавно характерны для одиночных видеокарт GeForce GTX 480 или 580. Но в данном случае мы получаем более чем удвоенную производительность. Прямое сравнение с GeForce GTX 590 (365 Вт) и Radeon HD 6990 (375/450 Вт) однозначно указывает на положительную тенденцию.

Конечно, упаковка двух GeForce GTX 680 на одну видеокарту заставила Nvidia немного снизить тактовые частоты. Что касается GPU, то мы получили снижение с 1006 до 915 МГц. NVIDIA не устаёт подчёркивать, что в режиме "GPU Boost" тактовая частота увеличивается, как минимум, до уровня 1019 МГц, что всего на четыре процента меньше схожей частоты GeForce GTX 680 на уровне 1058 МГц. В некоторых играх два GPU у GeForce GTX 690 разгонялись даже до 1071 МГц. В случае двух GeForce GTX 680 в связке SLI мы зафиксировали максимальные частоты на уровне 1110 МГц. Так что GeForce GTX 690 в системе действительно работает с высокой производительностью, тем более что память осталась на прежней частоте 1502 МГц по сравнению с одиночными видеокартами GTX 680.

{jphoto image=23803}

Что касается чистой производительности, то она очень и очень хороша. В большинстве тестов GeForce GTX 690 отставала не более чем на три процента от двух GeForce GTX 680 в конфигурации SLI (см. нашу статью Тест и обзор: AMD Radeon HD 7970 CrossFire против NVIDIA GeForce GTX 680 SLI). И это при меньшем на 55 Вт энергопотреблении! Видеокарта GeForce GTX 680 во многих тестах обгоняет Radeon HD 7970, поэтому GeForce GTX 690 можно смело назвать самой быстрой видеокартой на рынке. Единственным конкурентом остаётся система Crossfire из двух видеокарт Radeon HD 7970, которая позволяет оценить производительность грядущей Radeon HD 7990.

| NVIDIA GeForce GTX 690 | |

|---|---|

| Розничная цена | около 999 евро в Европе |

| Сайт производителя | Страница продукта NVIDIA |

| Технические спецификации | |

| GPU | 2x GK104 |

| Техпроцесс | 28 нм |

| Число транзисторов | 2x 3,54 млрд. |

| Тактовая частота GPU | 915 МГц + Boost (1019 МГц) |

| Тактовая частота памяти | 1502 МГц |

| Тип памяти | GDDR5 |

| Объём памяти | 2x 2048 Мбайт |

| Ширина шины памяти | 2x 256 бит |

| Пропускная способность памяти | 192,2 Гбайт/с |

| Версия DirectX | 11.1 |

| Потоковые процессоры | 2x 1536 (1D) |

| Текстурные блоки | 2x 128 |

| ROP | 2x 32 |

| Пиксельная скорость заполнения | 2x 29,3 Гпиксель/с |

| Минимальное энергопотребление | 15 Вт |

| Максимальное энергопотребление | 300 Вт |

| SLI/CrossFire | SLI |

| Уровень шума | |

| В режиме бездействия | 35,4 дБ(A) |

| Под нагрузкой | 52,4 дБ(A) |

| Энергопотребление | |

| В режиме бездействия | 119,4 Вт |

| Под нагрузкой | 470,2 Вт |

| Температура | |

| В режиме бездействия | 34 °C |

| Под нагрузкой | 77 °C |

Конечно, если вы пожелаете приобрести сегодня GeForce GTX 690, то система должна соответствовать минимальным требованиям. Вам следует обзавестись наиболее мощным CPU, да и настройки в играх необходимо выставлять самые высокие. Для разрешений 1680x1050 или 1920x1080 и стандартного качества GeForce GTX 690 (как и GeForce GTX 680 или Radeon HD 7970) будет избыточна. То есть вам следует выбирать разрешение не ниже 2560x1600 с высокими настройками сглаживания и анизотропной фильтрации, чтобы видеокарта смогла раскрыть свой потенциал.

Мы уже упоминали высокую производительность при низком энергопотреблении, но также отметим разумный уровень температуры и шума. Для видеокарты с двумя GPU новинка GeForce GTX 690 установила новые стандарты по данным характеристикам. Если в случае GeForce GTX 680 мы получили заметный прогресс при переходе на собственные системы охлаждения производителей видеокарт, то NVIDIA GeForce GTX 690 уже по максимуму использует штатные возможности - вряд ли мы получим дальнейшие улучшения. Что касается сравнения GeForce GTX 680 с разным объёмом памяти (2 или 4 Гбайт), то мы уже провели подобные тесты - вы можете ознакомиться с ними в статье "Тест и обзор: Palit GeForce GTX 680 4 GB Jetstream". Отметим, что польза от 4 Гбайт памяти наблюдается только в определённых и ограниченных сценариях. Поэтому мы не знаем, появятся ли на рынке видеокарты GeForce GTX 690 с 4 Гбайт памяти на GPU.

Наконец, остался самый больной вопрос, а именно вопрос цены. NVIDIA опубликовала рекомендованную розничную цену 829 евро для Европы, 35 999 рублей для России и 9 899 гривен для Украины. В рознице, особенно в первое время, видеокарты будут продаваться по цене чуть ниже 1000 евро. Две видеокарты GeForce GTX 680 можно приобрести по цене 950 евро в Европе или 36,5 тыс. рублей в России, и за такую цену вы получите чуть более высокую производительность. Впрочем, не будем забывать, что Nvidia установила на GTX 690 усовершенствованную систему охлаждения, да и вы получаете эксклюзивную видеокарту с отобранными чипами, так что своих денег она стоит. А на оптимальное соотношение производительность/цена топовые видеокарты, включая NVIDIA GeForce GTX 690, никогда и не нацеливались.

Преимущества NVIDIA GeForce GTX 690:

- Очень хорошее соотношение производительность/энергопотребление

- Низкий уровень шума в режиме бездействия и под нагрузкой

- Низкие температуры в режиме бездействия и под нагрузкой

- Снижение эффекта микро-подёргиваний

- DirectX 11.1

- PCI-Express 3.0

Недостатки NVIDIA GeForce GTX 690:

- Очень высокая цена

За высокую производительность и проявленные качества мы присуждаем видеокарте награду "Отличное железо".