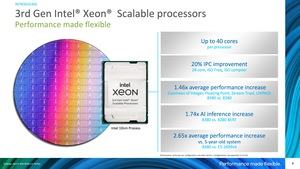

Вчера Intel представила третье поколение Xeon Scalable, также известное как Ice Lake-SP, что позволило распрощаться со стареющей архитектурой Skylake на серверном сегменте. Что касается настольных ПК, Intel недавно выполнила такой же шаг, перейдя на процессоры Rocket Lake-S. В мобильном же сегменте наиболее экономичные чипы перешли на новую микроархитектуру больше года. Серверные процессоры Ice Lake-SP наглядно демонстрируют проблемы Intel с 10-нм техпроцессом, поскольку третье поколение Xeon Scalable вышло сравнительно поздно, и скоро мы уже увидим преемника. Intel будет использовать новое поколение для смены платформы и частичной переориентации. Но сейчас позвольте рассказать подробности Ice Lake-SP.

Вчера Intel представила третье поколение Xeon Scalable, также известное как Ice Lake-SP, что позволило распрощаться со стареющей архитектурой Skylake на серверном сегменте. Что касается настольных ПК, Intel недавно выполнила такой же шаг, перейдя на процессоры Rocket Lake-S. В мобильном же сегменте наиболее экономичные чипы перешли на новую микроархитектуру больше года. Серверные процессоры Ice Lake-SP наглядно демонстрируют проблемы Intel с 10-нм техпроцессом, поскольку третье поколение Xeon Scalable вышло сравнительно поздно, и скоро мы уже увидим преемника. Intel будет использовать новое поколение для смены платформы и частичной переориентации. Но сейчас позвольте рассказать подробности Ice Lake-SP.

Поколение Ice Lake должно было перевести на новую архитектуру все сегменты еще в 2017 году: ноутбуки, настольные ПК и серверы. Однако возникли проблемы с 10-нм техпроцессом, которые до сих пор полностью не преодолены. Все же здесь мы получаем негативные последствия подхода Integrated Device Manufacturer (IDM), когда производство и разработка чипов находятся под одной крышей. Но Intel все же видит в IDM больше положительных сторон, скоро компания перейдет на концепцию IDM 2.0. И к 2023/24 году Intel планирует вернуть себе роль технологического лидера. С 7-нм техпроцессом Intel собирается догнать других производителей полупроводников и преодолеть все существующие проблемы, которые вряд ли можно было бы проиллюстрировать лучше, чем процессорами Rocket Lake-S

Подписывайтесь на группы Hardwareluxx ВКонтакте и Facebook, а также на наш канал в Telegram (@hardwareluxxrussia).

Но процессоры Ice Lake-H для ноутбуков с более чем четырьмя ядрами так и не вышли, как и модели Ice Lake-S для настольных ПК. Впрочем, с процессорами Xeon на Ice Lake Intel все же смогла выполнить план. Первые процессоры были отгружены клиентам еще в четвертом квартале 2020, произведено уже больше 200.000 чипов. И вчера Intel официально объявила новые CPU.

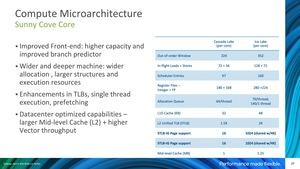

Новая архитектура: Sunny Cove

Для Intel архитектура Sunny Cove является первым существенным изменением базовой архитектуры CPU со времен Skylake в 2015 году. Шесть лет Intel продолжала улучшать архитектуру Skylake, несмотря на критику чиповый гигант все же смог существенно увеличить производительность архитектуры Skylake по сравнению с первым поколением CPU вплоть до итерации Comet Lake Refresh, которые оставались актуальными на настольном сегменте до недавнего выхода Rocket Lake-S. То же самое касается и улучшения 14-нм техпроцесса, поскольку архитектура Skylake хотя и вышла на 10-нм в гомеопатических дозах в виде Canon Lake, оптимизации между 14nm+, 14nm++ и 14nm+++ были весьма существенными. 14-нм процессоры Rocket Lake-S достигают частоты до 5,3 ГГц на одиночных ядрах и до 5,1 ГГц на всех восьми ядрах.

Однако теперь Sunny Cove знаменует переход на новую архитектуру, хотя и ей уже исполнилось два года. Intel внесла ряд изменений, специфичных для Xeon.

Intel для Sunny Cove использует 5-wide конвейер с внеочередным выполнением. В нем теперь имеются четыре станции Unified Reservation Stations (RS), что позволяет добиться лучшего параллелизма выполнения инструкций, чем в случае Skylake. Возможно, для предотвращения уязвимостей Spectre, Intel выделила четыре фиксированных порта для AGU (Address Generation Unit). К каждой паре AGU привязан блок чтения/записи (Load/Store). Для вычислений VEC и INT теперь присутствуют дополнительные вычислительные блоки на соответствующих портах. Все эти меры призваны увеличить производительность архитектуры.

Передняя часть конвейера получила большую емкость, Intel оптимизировала предсказания ветвлений. Вычислительные блоки Ice Lake были увеличены по двум измерениям: глубина и ширина конвейера, сейчас процессоры могут выполнять больше инструкций и поддерживают больше наборов инструкций.

Intel увеличила кэши и буферы по сравнению с Cascade Lake. Теперь они могут вмещать больше данных, количество блоков Load/Store было увеличено. В этом кроется одно из изменений Ice Lake-SP по сравнению с вышедшей ранее потребительской версией: кэш L2 увеличился с 512 кбайт до 1,25 Мбайт на ядро. В случае Cascade Lake емкость составляла 1 Мбайт на ядро.

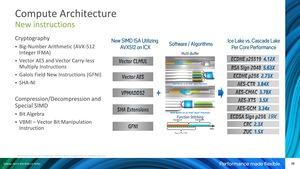

Также Sunny Cove поддерживает новые наборы команд ISA. Среди них Vector-AES и SHA-NI, но также и AVX512. Первые два обеспечивают аппаратное ускорение шифрования и дешифровки. В результате мы должны получить ускорение многих алгоритмов криптографии, что как раз соответствует упомянутым Intel оптимизациям под специальные приложения. Прирост производительности по сравнению с процессорами Cascade Lake весьма существенный.

Новые процессоры Ice Lake SP содержат до 40 ядер Sunny Cove, инновации коснулись также интерфейса памяти и снижения задержек кэша L3 и памяти.

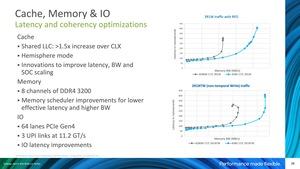

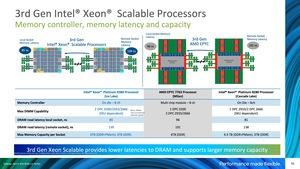

По сравнению с предыдущим поколением Xeon, Intel увеличила число каналов памяти с шести до восьми. На каждом канале могут использоваться два модуля. По частоте памяти Intel перешла с DDR4-2933 на DDR4-3200 - по крайней мере, для самых быстрых моделей Xeon. Для сравнения: AMD тоже поддерживает DDR4-3200 с процессорами EPYC, но только с одним модулем на канал. Увеличение пропускной способности памяти со снижением задержек - в этом кроется секрет нового контроллера памяти Intel.

Несколько процессоров Xeon связываются друг с другом в многосокетной системе через Ultra Path Interconnect (UPI). Intel обеспечила каждый CPU тремя каналами UPI, каждый на 11,2 GT/s. Ранее пропускная способность составляла 9,6 и 10,4 GT/s. Таким образом, Intel удалось немного ускорить скорость передачи данных в многосокетных системах. Еще одним важным фактором является поддержка PCI-Express 4.0 - через два года после того, как AMD перешла на PCI Express 4.0 со вторым поколением EPYC, обеспечив возможность более быстрого подключения дополнительных компонентов в системе. С 64 линиями PCI Express у процессоров Ice Lake Intel предлагает лишь половину того, что дает AMD. У двухсокетной системы число линий будет 128, поскольку Intel использует UPI для связи между сокетами. AMD предоставляет лишь 192 линий в режиме 2S, поскольку 64 линий PCIe выделены под связь двух сокетов.

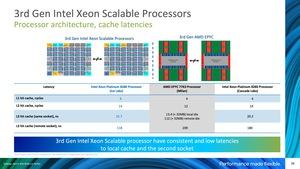

Intel указывает чуть более высокие задержки кэша L1, поскольку для попадания требуется больше тактов, улучшений в кэше L2 по сравнению с Cascade Lake не произошло, поэтому у AMD имеется небольшое преимущество. Однако с процессорами EPYC следует внимательнее оценивать кэш L3, поскольку данные могут храниться как в локальном кэше L3 CCD, так и в других CCD. Локальная задержка L3 у AMD составляет 13,4 нс, у Intel - 21,7 нс. Однако если требуется передать данные с кэша другого CCD, то задержка 112 нс у AMD существенно выше. Здесь отлично видна разница между монолитным дизайном и чиплетами. Но следует отметить, что у AMD кэш L3 составляет до 256 Мбайт, а у Intel - всего 38,5 Мбайт.

Еще одна проблема с задержками кроется в доступе к кэшу L3 удаленного сокета в многосокетной системе. Здесь у Intel задержка достигает 118 нс (у Cascade Lake: 180 нс), что существенно меньше платформы AMD EPYC с задержкой 209 нс.

Intel лучше позиционируется и по задержкам памяти 85 и 139 нс вместо 96 и 191 нс. Кроме того, частота DDR4-3200 поддерживается для двух DIMM на канале памяти, как мы уже отмечали выше, а в случае процессоров AMD EPYC - только для одного модуля на канал.

AMD и Intel с процессорами Ice Lake-SP не отличаются по максимальной емкости на сокет (оба поддерживают 4 Тбайт памяти), но Intel поддерживает один модуль Optane DC Persistent Memory на канал памяти, что увеличивает общую емкость до 6 Тбайт на сокет.

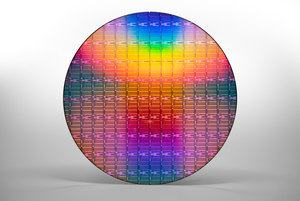

Дизайн SoC и производство

Процессоры Ice Lake SP производятся по 10-нм техпроцессу, но по улучшенному варианту, а не техпроцессу 10 nm SuperFin, как нынешние Tiger Lake для ноутбуков. С улучшенным техпроцессом Intel, вероятно, пытается окончательно закрыть проблемы, связанные с 10 нм.

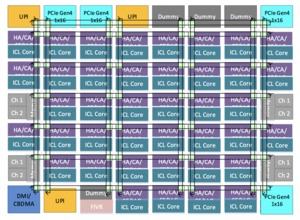

Самый крупный вариант Ice Lake-SP предлагает 40 ядер. Строение чипа приведено на иллюстрации. Хорошо видна сетчатая топология (mesh), блоки в SoC соединены соответствующим образом. Ядра Sunny Cove расположены в центре, остальные компоненты, такие как контроллеры восьми каналов памяти, четырех линий 16 PCI Express 4.0, трех подключений UPI и интерфейса DMI/DMA вынесены на периферию. Встроенный контроллер питания (FIVR) разделяет наполовину свободный участок (Dummy), которых насчитается еще три.

Intel не указывает подробности размера кристалла и числа транзисторов. Но можно ожидать, как минимум, два-три кристалла разных размеров. Вполне вероятно разделение на LCC (Low Core Count) до 18 ядер, HCC (High Core Count) до 28 ядер и XCC (Extreme Core Count) до 40 ядер.

Процессоры Ice Lake SP устанавливаются в новый сокет LGA4189-4/5 SMT с 4.189 контактами и габаритами 77,5 x 56,5 мм. Процессоры Skylake-SP и Cascade Lake-SP использовали одинаковый сокет, но Intel пришлось перейти на новый из-за увеличения числа каналов памяти и поддержки PCI Express 4.0.

Intel использует чипсет C620A. Он подключается к процессору четырьмя каналами DMI 3.0 и предлагает 20 дополнительных линий PCI Express 3.0, 10x USB 3.0, 14x USB 2.0 и 14x SATA III.

До 40 ядер, но тактовая частота не увеличилась

Как обычно, Intel предлагает широкий ассортимент процессоров. Следует различать модели, которые предназначены для работы в системах 1S и 2S, либо 4S и 8S. Кроме того, есть процессоры, которые обеспечивают сравнительно высокую частоту ядер, процессоры с максимальной емкостью SGX Enclave. Есть и специальные модели, которые рассчитаны на водяное охлаждение, ориентированы на облачные инстанции, сетевые сервисы или мультимедиа.

Пару слов о номенклатуре: все процессоры Xeon на основе Ice Lake-SP называются x3xx. Первая цифра и две последних уже разделяют линейки Xeon Platinum и Xeon Gold по отдельным моделям.

Добавки H и HL указывают на модели, предназначенные для работы в конфигурациях 4S и 8S. Есть отличия по максимальной емкости памяти. Процессоры Y поддерживают Speed Select Technology с Performance Profiles 2.0 (SST-PP). Модели без Y поддерживают Speed Select Technology, но также SST Base Frequency (SST-BF), SST Core Power (SST-CP) и SST Turbo Frequency (SST-TF) - здесь следует проверять характеристики каждой модели. Процессоры для облачных сервисов имеют добавки P и V. Добавка M указывает на процессоры, ориентированные на мультимедиа, N - на сетевые службы. Как и в случае настольных CPU, добавка T указывает на процессоры Xeon с меньшим TDP, которые могут работать на высоких температурах. Есть и другие добавки, так что здесь ассортимент Intel стал весьма запутанным.

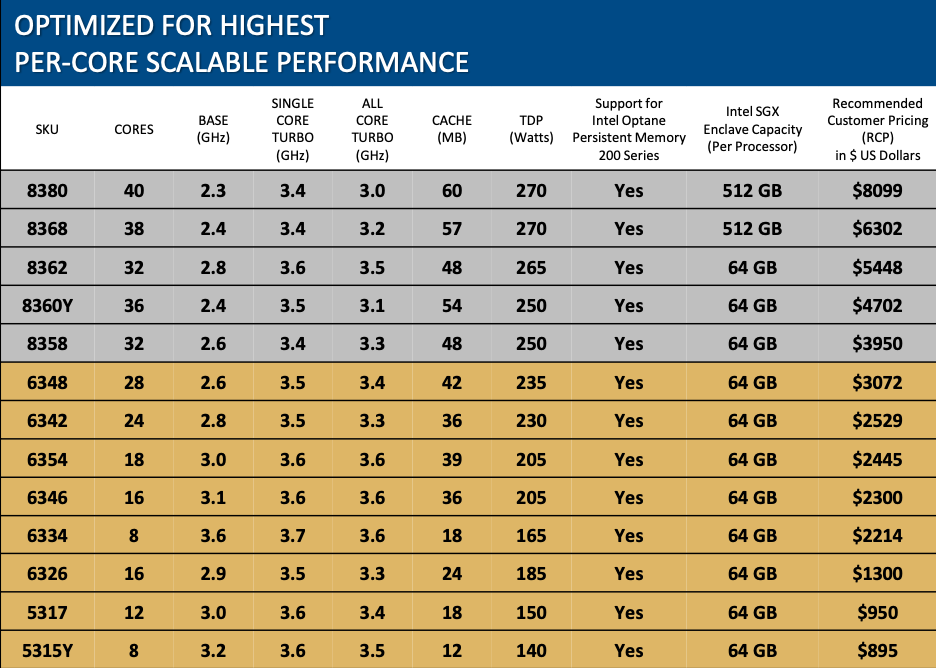

Приведенные выше модели формируют костяк нового поколения. Здесь можно видеть Xeon Platinum 8380 с 40 ядрами на базовой частоте 2,3 ГГц, Turbo для одного ядра 3,4 ГГц и для всех ядер 3,0 ГГц. Емкость кэша достигает 60 Мбайт, но он все равно составляет около четверти от процессоров AMD EPYC в максимальной конфигурации. TDP - 270 Вт, а емкость SGX Enclave составляет до 512 Гбайт. Память Optane Persistent Memory поддерживается всеми моделями. В линейке Xeon Platinum доступны процессоры с числом ядер от 32 до 40. В линейке Xeon Gold - от 8 до 28. Базовые частоты и Boost меняются в зависимости доступных ядер и TDP. Но ни один из процессоров выше так и не достигает уровня 4 ГГц.

TDP 270 Вт для Xeon Platinum 8380 можно назвать серьезным увеличением по сравнению с 205 Вт у Xeon Platinum 8280. Но увеличение числа ядер на 40% обошлось всего в 30% прироста по энергопотреблению. Cascade Lake AP из двух кристаллов остались в прошлом, теперь Intel упаковывает 40 ядер в монолитном дизайне.

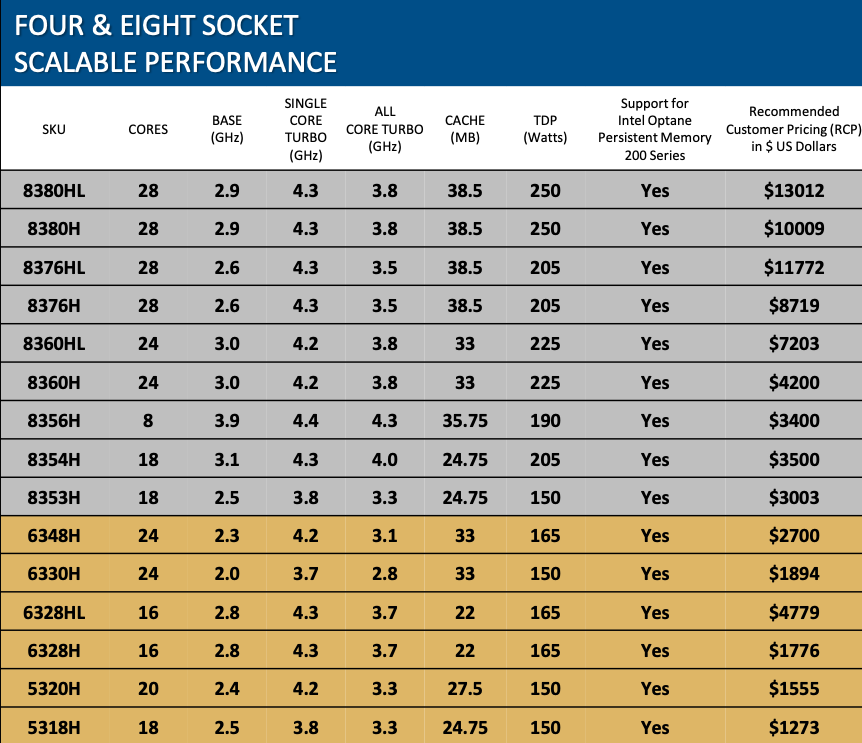

Процессоры H и HL для систем 4S и 8S все еще базируются на Cooper Lake. Максимальное число ядер составляет 28. Имеются отличия по памяти и поддержке Optane Persistent Memory. Частота Turbo для одиночных ядер достигает 4,4 ГГц. Здесь хорошо видно, что 14-нм поколение работает на более высоких тактовых частотах.

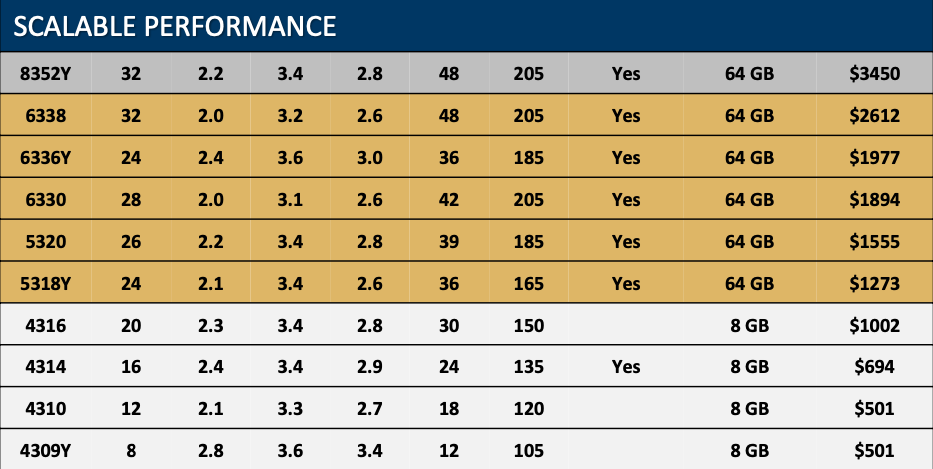

Intel не фокусирует внимание на SGX Enclave в линейке Scalable, которая состоит из процессоров Platinum, Gold и Bronze. Здесь Intel предлагает до 32 ядер, тактовые частоты можно назвать умеренными, как и классификацию TDP.

В таблице выше приведены специальные модели, которые рассчитаны на высокие температуры, либо сетевые сервисы или мультимедиа. Тактовые частоты тоже можно назвать умеренными, потому прирост производительности третьего поколения Xeon достигается число ядер и IPC архитектуры Sunny Cove.

Безопасность через SGX и TME

С процессорами Xeon на основе Ice Lake Intel добавила ряд инноваций. Среди них - Intel SGX, шифрование памяти, защита прошивки и новое аппаратное ускорение криптографии.

Все это должно улучшить безопасность аппаратных компонентов, BIOS и прошивки, операционной системы и гипервизора. Если один из упомянутых компонентов будет скомпрометирован, то смысла защищать вышележащий программный стек уже нет. Тема безопасности для Intel приоритетна, поскольку за последние годы компания растеряла доверие и планирует его восстановить.

Один из важных шагов с новым поколением Xeon - технология Intel SGX (Software Guard Extensions) с добавлением Trusted Execution Environment (TEE), причем SGX впервые нашла поддержку в процессорах Xeon. Она ранее была доступна в процессорах Xeon-E, но теперь ею обзавелась и линейка Scalable. Приложения, использующие TEE, могут обходить операционную систему и гипервизор для доступа к защищенной области памяти, например. То есть код и данные больше недоступны для уязвимых уровней программного стека, что должно предотвратить соответствующие векторы атаки.

На каждый Enclave можно защищать 1 Тбайт данных и кода. Но один процессор Xeon может работать с Enclave емкостью до 512 Гбайт, причем такой объем доступен не на всех моделях. Здесь стоит обращать внимание на выбранный CPU. Но два Ice Lake Xeon могут формировать Enclave на 1 Тбайт в системе 2S.

Из новшеств Ice Lake-SP можно назвать и поддержку TME (Total Memory Encryption) или MKTME (Multi-Key Total Memory Encryption). Данные в памяти защищены шифрованием TME, доступ к ним возможен только по специальному ключу, который создается один раз при старте системы. Избыточные расходы производительности из-за шифрования составляют всего 3%, хотя здесь все зависит от приложения. В принципе, Intel с TME достигает уровня, который AMD предложила ранее с поддержкой SME (Secure Memory Encryption) и SEV (Secure Encrypted Virtualization). Но в случае SME можно шифровать любую область оперативной памяти. Технология TSME (Transparent Secure Memory Encryption) позволяет зашифровать всю память при загрузке системы. В таком случае поддержки шифрования со стороны программного обеспечения не требуется, в отличие от SME.

Еще один компонент - Platform Firmware Resilience (PFR). Для него используется Intel FPGA, который добавляет корень доверия и валидирует критически важные компоненты, такие как прошивка. А в случае модификации обнаруживает изменения и корректирует. Отслеживается BIOS, прошивка платформы, микрокод процессора и существующие образы восстановления. Intel PFR или FPGA также отслеживает важные системные шины, определяет или фильтрует трафик, который может принадлежать вредоносному коду. То есть мы получаем своего рода брандмауэр, и в случае сомнения трафик будет блокироваться, чтобы предотвратить потенциальную атаку.

Optane Persistent Memory, Optane SSD и быстрая сеть

Конечно, 3-е поколение процессоров Xeon фокусируется на увеличении числа ядер до 40 на архитектуре Sunny Cove. Но платформа также поддерживает 8x DDR4-3200, 64x PCIe 4.0 и 3x UPI. Однако Intel приводит и другие преимущества.

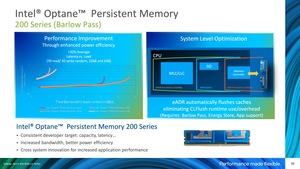

Intel представила Optane Persistent Memory 200 Series или Barlow Pass в середине прошлого года. Самой важной чертой можно назвать увеличение пропускной способности памяти (+25%) по сравнению с первым поколением, поскольку Optane DIMM работают на той же частоте, что и основная память (DDR4-3200).

Максимум половину слотов DIMM процессора Xeon можно оснащать Optane DC Persistent Memory (один модуль DRAM и один Persistent Memory на канал). Память Persistent Memory в формате DIMM может устанавливаться планками 128, 256 и 512 Гбайт. Максимальный объем памяти, таким образом, составляет 8x 256 GB DDR4 + 8x 512 GB Optane DC Persistent Memory, то есть 6 Тбайт на сокет.

От настроек системы зависит, как именно будут использоваться Optane DC Persistent Memory. В режиме App Direct Mode приложениям обеспечивается прямой доступ к памяти. Intel для этой цели как раз разработала модель программирования. Все приложения с ее поддержкой могут работать с памятью Optane DC Persistent Memory в режиме App Direct Mode.

Второй режим Storage over App Direct переводит планки Optane DC Persistent Memory в своего рода SSD. Можно выбирать размер блоков и файловую систему, после чего работать с памятью как с обычным диском. Есть и смешанный режим Mixed Mode, в котором разные каналы памяти можно настраивать индивидуально.

Как еще один слой хранения данных Intel рассматривает Optane SSD. Из прошлогодних новинок здесь упоминается Optane SSD P5800X на втором поколении памяти Optane, который теперь реализован в виде PCI Express 4.0 SSD. Optane SSD P5800X должен работать в два раза быстрее предшественника Optane SSD P4800X. Улучшенная память Optane как раз приводит к увеличению производительности. Второй фактор - подключение Optane SSD P5800X по четырем линиям PCIe 4.0, что необходимо для высокой пропускной способности. Intel говорит о скоростях до 7,2 и 6,2 Гбайт/с по чтению и записи, соответственно. Производительность IOPS с блоками 4K составляет 1,5 млн. Для блоков 512 байт заявлены 4,6 млн. IOPS.

Особую роль в случае Optane SSD играют очень низкие задержки от 10 до 100 нс при высоких скоростях передачи данных. В случае классических SSD задержки порядка 100 нс увеличиваются при повышении пропускной способности, Optane SSD P5800X сохраняет их на низком уровне даже на 8 Гбайт/с.

Intel указывает DWPD (Drive Writes Per Day) на уровне 100. То есть емкость накопителя можно 100 раз перезаписывать каждые сутки. Емкости SSD составляют 400 GB, 800 GB, 1,6 TB или 3,2 TB, в зависимости от модели.

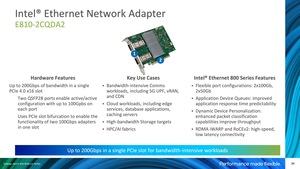

Из других компонентов экосистемы можно отметить сетевые адаптеры, которые теперь подключаются через PCI Express 4.0 и работают на скорости 2x 100 Гбит/с. Протоколы RDMA iWARP и RoCEv2 призваны обеспечить максимальную скорость передачи данных, низкие задержки и определенный уровень QoS.

Последним компонентом является FPGA линейки Agilex. Они были официально представлены несколько месяцев назад, но теперь перешли на этап массового производства. Они отлично вписываются в линейку вместе с процессорами ICX.

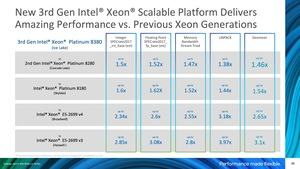

Собственные тесты Intel

Конечно, Intel опубликовала и собственные тесты, которые демонстрируют преимущества новой линейки. Без специальных программных оптимизаций и поддержки наборов инструкций производительность увеличивается на 50-74%. С оптимизациями в сфере VNNI можно рассчитывать на десятикратный рост производительности.

Intel проводит сравнение с предшественником Cascade Lake. По сравнению со Skylake-SP или даже Haswell прирост производительности будет существенно выше. Здесь сказывается архитектура, число ядер и частоты, а также поддержка VNNI и AVX512.

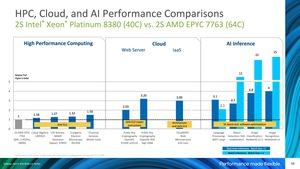

Конечно, Intel сравнила себя и с AMD. Здесь Intel использовала третье поколение процессоров EPYC, то есть современные чипы на ядрах Zen 3. Но Intel провела тесты только в приложениях, которые могут ускоряться AVX512. Несмотря на меньшее число ядер (2x 40 против 2x 64), Intel заявляет о приросте производительности. Причем он еще более впечатляет в сфере вычислений ИИ, где работает ускорение VNNI. Если бы AMD проводила собственные тесты, то наверняка отобрала бы приложения, которые лучше показывают себя на собственных чипах компании.

К преимуществам Intel можно отнести доступность

Intel занимает значительную долю на рынке дата-центров, но к весомым преимуществам можно отнести доступность третьего поколения Xeon. У AMD наблюдаются такие же проблемы с доступностью, что и в случае настольных процессоров. Все чипы AMD производятся на мощностях TSMC (причем вычислительные кристаллы CCD идентичны у двух категорий продуктов).

С 40 ядрами против 64 на сокет и с 64 линиями PCI Express против 128 у AMD есть преимущество по более высокой плотности ядер и лучшим возможностям подключения дополнительных компонентов. Что касается памяти, Intel уже догнала AMD с восьмиканальным интерфейсом. Также Intel находится на равных по емкости и скорости памяти.

Как обычно, выбор между моделями EPYC или Xeon зависит от сферы применения. Для сегмента дата-центров важны не только тесты, но и многие другие факторы.

Приятно удивляют и цены, здесь Intel уловила веяние времени. Xeon Platinum 8380 стоит "всего" $8.099 - на 20% дешевле предшественника. Ситуация еще интереснее в среднем сегменте, где процессоры оказались до 60% дешевле при сравнении с предшественниками. Конечно, со стороны EPYC конкуренция видна, но заявленные цены обычно имеют мало отношения к реальности, особенно при покупке крупными клиентами. AMD и Intel дают существенные скидки.

Наши коллеги AnandTech опубликовали первый тест Ice Lake-SP, поэтому можно ознакомиться с результатами производительности не только по бенчмаркам Intel.